L'Autopilot de Tesla fait l'objet d'une nouvelle enquête visant à vérifier l'efficacité d'une mise à jour publiée après le rappel de plus de 2 millions de véhicules

la NHTSA exprime des doutes

Les autorités américaines ont annoncé avoir ouvert une nouvelle enquête sur le système d'aide à la conduite Autopilot de Tesla. Cette enquête vise à déterminer si l'entreprise a apporté des correctifs adéquats aux défaillances techniques de l'Autopilot qui ont entraîné le rappel de plus de deux millions de véhicules Tesla en décembre dernier. L'agence fédérale NHTSA (National Highway Traffic Safety Administration) affirme qu'elle a ouvert l'enquête après avoir relevé des préoccupations liées à des accidents survenus après que les véhicules ont eu la mise à jour logicielle du rappel installée. Il s'agit d'un nouveau coup dur pour Tesla qui est dans une phase descente.

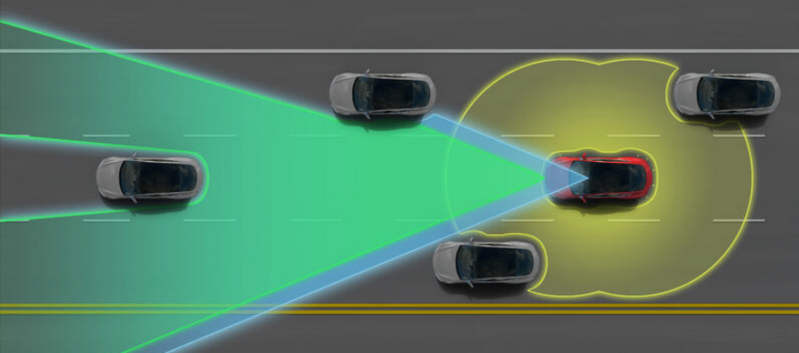

Tesla et la NHTSA ont annoncé un "rappel de sécurité" de tous les véhicules Tesla équipés de l'Autopilot en Amérique du Nord en décembre dernier. Cela représente une flotte gigantesque de plus de 2 millions de véhicules et le rappel visait à corriger un système défectueux censé s'assurer que les conducteurs sont attentifs lorsqu'ils utilisent l'Autopilot. Le rappel marquait la conclusion d'une enquête pluriannuelle de la NHTSA sur les crashs des véhicules Tesla en mode Autopilot contre des véhicules d'urgence en stationnement ou arrêtés sur l'autoroute. Le "correctif" du rappel a été publié via une mise à jour logicielle en direct.

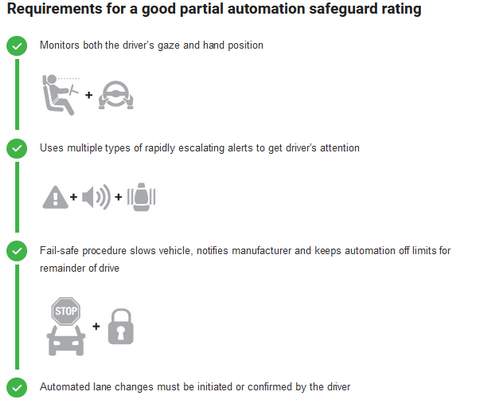

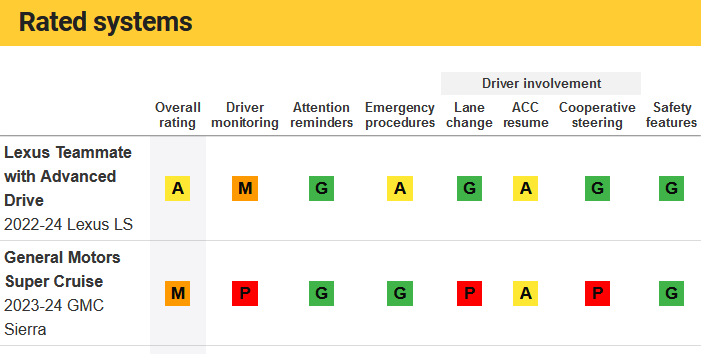

Parmi les autres conclusions de l'enquête, la NHTSA avait constaté que le nom "Autopilot" peut "amener les conducteurs à croire que l'automatisation a des capacités plus importantes qu'elle ne l'est". L'agence fédérale avait également constaté que l'Autopilot de Tesla peut décourager les conducteurs de prendre le contrôle manuel du véhicule par rapport à d'autres systèmes de conduite automatisée, car cela désactive l'aide au centrage dans la voie Autosteer. Mais Tesla a indiqué qu'il n'était pas d'accord avec l'allégation de la NHTSA selon laquelle une surveillance inappropriée du conducteur était à l'origine de ces cas d'accidents.

La plus haute responsable de la NHTSA à l'époque, Ann Carlson, a déclaré en décembre que la sonde de l'agence avait déterminé qu'il fallait en faire plus pour s'assurer que les conducteurs sont engagés lorsque l'Autopilot est en cours d'utilisation. « L'une des choses que nous avons déterminées est que les conducteurs ne sont pas toujours attentifs lorsque ce système est en marche », a déclaré Carlson. La NHTSA a ajouté en décembre qu'elle avait constaté que l'Autopilot de Tesla peut fournir des contrôles inadéquats d'engagement et d'utilisation du conducteur pouvant conduire à une mauvaise utilisation prévisible.

L'entreprise a toutefois accepté d'ajouter davantage d'avertissements et d'alertes lorsque les conducteurs utilisent les fonctions de l'Autopilot, d'où le rappel. Cependant environ six mois plus tard, la NHTSA semble avoir des doutes sur l'efficacité de la mise à jour publiée dans le cadre du rappel après que de nouveaux accidents ont été signalés et que l'agence a été informée de certaines préoccupations concernant les correctifs. En raison de ces préoccupations, la NHTSA a décidé d'ouvrir une nouvelle enquête sur l'Autopilot pour déterminer si les correctifs sont adéquats. Voici un extrait de la déclaration de la NHTSA :

La NHTSA affirme que l'enquête concerne tous les véhicules Tesla équipés de l'Autopilot produits entre 2012 et 2024 - y compris le Cybertruck, qui fait déjà l'objet d'un rappel en raison de pédales d'accélération défectueuses. Cela représente une flotte d'un peu plus de 2 millions de véhicules Amérique du Nord. Selon certains analystes, le rappel initial a toujours été perçu comme un compromis. Le fait que Tesla ne soit pas d'accord avec les conclusions de la NHTSA et que le rappel proprement dit consiste principalement en une légère augmentation des alertes a donné l'impression d'un compromis important de part et d'autre.Envoyé par NHTSA

Aujourd'hui, il semble que la NHTSA veuille aller plus loin. Par ailleurs, ce n'est pas la première fois que cette mise à jour logicielle est examinée de près. Missy Cummings, experte en robotique et ancienne conseillère principale en sécurité de la NHTSA, avait déclaré que le correctif était "très vague" peu après son annonce et qu'il ne serait probablement pas aussi solide que la NHTSA le souhaiterait. De plus, les tests effectués par les experts en sécurité de Consumer Report ont révélé que la mise à jour ne va pas assez loin pour empêcher les mauvaises utilisations ou s'attaquer aux causes profondes de l'inattention du conducteur.

En février, Consumer Reports a déclaré que ses tests de la mise à jour du rappel de l'Autopilot de Tesla ont révélé que les changements ne répondaient pas de manière adéquate à de nombreux problèmes de sécurité soulevés par la NHTSA et a exhorté l'agence à exiger de Tesla qu'il prenne des mesures plus strictes, affirmant que "le rappel de l'entreprise s'attaque à des inconvénients mineurs plutôt que de résoudre les vrais problèmes". Mais les problèmes de Tesla ne s'arrêtent pas là ; l'entreprise est confrontée à des dizaines d'enquêtes.

Séparément, depuis 2016, la NHTSA a ouvert plus de 40 enquêtes spéciales sur les accidents de Tesla dans des cas où des systèmes de conduite tels que l'Autopilot étaient soupçonnés d'être utilisés, avec 23 décès liés aux accidents signalés à ce jour. Tesla a révélé en octobre que le département américain de la Justice (DOJ) avait émis des citations à comparaître concernant son système de conduite autonome intégrale (Full Self-Driving - FSD) et l'Autopilot. En outre, il a été rapporté en 2022 que Tesla faisait l'objet d'une enquête criminelle.

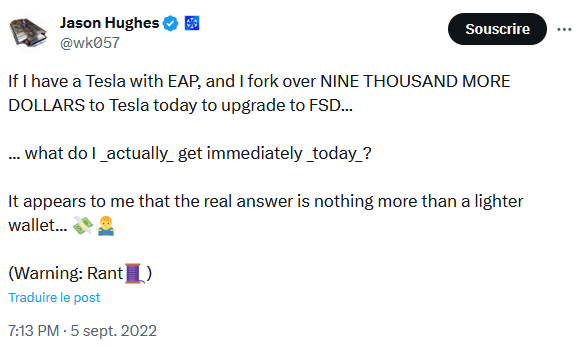

En février 2023, Tesla a rappelé plus de 362 000 véhicules américains pour mettre à jour son logiciel FSD Beta après que la NHTSA a déclaré que les véhicules ne respectaient pas suffisamment les lois sur la sécurité routière et pouvaient provoquer des accidents. Il convient de noter que le logiciel FSD coûte 8 000 dollars et est toujours dans une phase bêta.

Source : document de la NHTSA (PDF)

Et vous ?

Quel est votre avis sur le sujet ?

Que pensez-vous de la nouvelle enquête qui vise l'Autopilot de Tesla ?

Que pensez-vous des raisons à l'origine de l'ouverture de la nouvelle enquête de la NHTSA ?

Voir aussi

Tesla rappelle plus de 2 millions de véhicules pour réparer un système de surveillance défectueux d'Autopilot, soit quasiment tous les véhicules vendus au USA, encore un désastre pour Elon Musk

Tesla annonce un rappel massif de tous les Cybertruck pour pédales d'accélérateur défectueuses, vous n'avez même plus besoin d'activer l'Autopilot pour avoir un accident

Cybertruck de Tesla : Freinages brusques et inattendus avec Autopilot activé, code d'erreur empêchant la recharge, les propriétaires accusent Tesla d'avoir précipité la sortie du véhicule

Répondre avec citation

Répondre avec citation

Partager