Bonjour,

voici mon problème: étant donnés

- un terrain à deux dimensions (défini par un buffer de W * H éléments),

- une caméra (définie par ses coordonnées (x, y) sur le terrain et son orientation (angle a)),

- et son champ de visibilité (calculé a partir de la position et l'orientation de la caméra),

comment calculer la "meilleure position" P de la caméra sur le terrain, pour un angle a fixé?

définition de "meilleure position": un couple de coordonnées (x, y) qui génère un champ de visibilité dont les points appartiennent tous au terrain,

ou bien, s'il existe un ensemble E de points du champ de visibilité en dehors du terrain, que le point de E le plus proche de la caméra soit à une distance la plus éloignée possible de la caméra.

je ne vois pas bien comment aborder la partie en rouge...

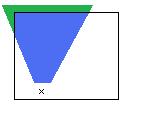

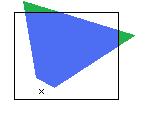

voila des schémas pour aider a se représenter les données:

angle = 0

angle = a

légende:

rectangle noir --> le terrain

la croix --> un couple de coordonnées de la caméra

points bleus --> points du champs de visibilités appartenant au terrain

points verts --> points du champs de visibilités sortant des limites du terrain

merci pour votre aide

[Edit: reformulation du problème]

Pour un angle donné, comment calculer la (une) position de la caméra telle que son champ de vision contienne le plus de points possibles appartenant au terrain (la surface bleue sur les dessins), sans intersecter les bords du terrain auxquels la caméra tourne le dos?

Répondre avec citation

Répondre avec citation

Partager