L'IA inspire intrigue, peur et confusion, mais les organisations doivent réduire les risques inhérents,

Afin de sécuriser leurs propres systèmes intelligents, daprès un nouveau rapport

L'avenir de l'intelligence artificielle continue dinquiéter plusieurs, y compris les acteurs dans le domaine de la sécurité de linformation. Un nouveau rapport du Forum sur la sécurité de l'information (ISF) ne dit pas le contraire en indiquant que « l'intelligence artificielle inspire l'intrigue, la peur et la confusion dans la même mesure ». Mais le rapport a toutefois conclu que pour prospérer dans cette nouvelle ère, les organisations doivent réduire les risques posés par l'IA et tirer le meilleur parti des possibilités qu'elle offre. Ce qui signifie sécuriser leurs propres systèmes intelligents et déployer leurs propres défenses intelligentes, daprès le rapport.

Ces récentes recherches de lISF, un organisme international et indépendant dont le but est la recherche des bonnes pratiques dans le domaine de la sécurité de l'information, ont révélé que l'intelligence artificielle présente déjà des risques pour les actifs d'information, ainsi que la possibilité d'améliorer considérablement les cyberdéfenses. Dans son effort de soutien aux organisations à léchelle mondiale, l'ISF a publié lédition doctobre 2019 de son rapport « Demystifying Artificial Intelligence in Information Security », le dernier recueil des organisations qui aide les professionnels de la sécurité à éliminer la confusion, démystifiant l'intelligence artificielle dans le domaine de la sécurité de l'information.

« L'IA crée une nouvelle frontière en matière de sécurité de l'information. Les systèmes qui apprennent, raisonnent et agissent de manière indépendante reproduiront de plus en plus le comportement humain - et comme les humains, ils seront défectueux, mais aussi capables de réaliser de grandes choses. L'IA pose de nouveaux risques pour l'information et rend certains risques existants plus dangereux », a déclaré Steve Durbin, directeur général de l'ISF.

« Cependant, il peut aussi être utilisé pour le bien et devrait devenir un élément clé de l'arsenal défensif de toute organisation. Les dirigeants d'entreprises et les responsables de la sécurité de l'information doivent comprendre à la fois les risques et les opportunités avant d'adopter des technologies qui deviendront bientôt un élément crucial de leur activité quotidienne », a-t-il ajouté.

Au fur et à mesure que les systèmes d'IA seront adoptés par les organisations, ils deviendront de plus en plus essentiels aux activités quotidiennes de l'entreprise. Selon le rapport, quelle que soit la fonction pour laquelle une organisation adopte l'IA, ces systèmes et l'information qui les appuie présentent des vulnérabilités inhérentes et sont exposés à des menaces à la fois accidentelles et conflictuelles. Les systèmes d'IA compromis peuvent prendre de mauvaises décisions et par conséquent produire des résultats inattendus, a écrit ISF.

Le rapport relève également les risques d'attaques sophistiquées basées sur l'intelligence artificielle, qui peuvent compromettre l'information et avoir de graves répercussions sur l'entreprise à une vitesse et à une échelle plus grandes que jamais auparavant. Prendre des mesures à la fois pour sécuriser les systèmes d'IA internes et pour se défendre contre les menaces externes basées sur lIA deviendra d'une importance vitale pour réduire les risques liés à l'information. Pour cela, LISF a noté que les organisations doivent être prêtes à adapter leurs défenses pour faire face à l'ampleur et à la complexité des cyberattaques basée sur lIA.

Selon le rapport, l'IA peut automatiser de nombreuses tâches, aidant les services de sécurité en sous-effectif à combler le manque de compétences spécialisées et à améliorer l'efficacité de leurs spécialistes. Cependant, daprès lISF, les attaquants ne restent pas les bras croisés. Au fur et à mesure que les menaces basées sur l'IA deviennent plus complexes, les responsables de la sécurité devront utiliser des défenses soutenues par l'IA simplement pour rester à jour, a recommandé le rapport.

« Au fur et à mesure que les premiers adeptes de l'IA défensive s'habituent à une nouvelle façon de travailler, ils en voient les avantages en termes de capacité à contrer plus facilement les menaces existantes. Cependant, une course aux armements se développe. Les outils et techniques d'intelligence artificielle qui peuvent être utilisés pour la défense sont également à la disposition des acteurs malveillants, notamment les criminels, les pirates et les groupes parrainés par des États », a déclaré M. Durbin.

« Tôt ou tard, ces adversaires trouveront des moyens d'utiliser l'intelligence artificielle pour créer de nouvelles menaces telles que des logiciels malveillants intelligents - et à ce moment-là, l'intelligence artificielle défensive ne sera pas seulement " agréable à avoir ". Ce sera une nécessité. Les praticiens de sécurité qui utilisent les contrôles traditionnels ne seront pas en mesure de faire face à la vitesse, au volume et à la complexité des attaques », a-t-il ajouté.

Les dérives de lIA ne sappliquent pas quà la sécurité de linformation. Plusieurs autres applications de la technologie, telle que certaines utilisations de la reconnaissance faciale, sont décriées comme étant néfastes pour lhumanité.

En mars dernier, à loccasion de la conférence South by Southwest (SXSW) qui sest tenue à Austin, au Texas, Elon Musk, le patron de Tesla et de SpaceX, a réitéré ses avertissements concernant le danger de lintelligence artificielle. Selon Musk, il devrait exister un organisme de réglementation supervisant le développement de cette technologie.

« Je ne suis pas normalement un partisan de la réglementation et de la surveillance - je pense quon devrait généralement pécher par excès de minimisation de ces choses-là, mais il sagit dune situation où le public court un très grave danger », avait prévenu Musk.

Le professeur Jim Al-Khalili a également averti, lannée dernière lors dun briefing à Londres, que lintelligence artificielle serait « un plus grand risque pour lhumanité que les changements climatiques et le terrorisme ». Le Président de la British Science Association a ajouté que lintelligence artificielle, que ce soit en bien ou en mal, impacterait plus le monde que toutes ces autres questions brûlantes de lheure.

Il a également évoqué le recours à une réglementation publique en avertissant que le réel potentiel de lintelligence artificielle ne saurait être révélé sans une plus grande transparence et un engagement public. Pour lui, tant que le gouvernement, lindustrie et les universitaires ne se concertent pas pour agir, lintelligence artificielle pourrait vite devenir incontrôlable et centralisée entre les mains de quelques sociétés extrêmement puissantes.

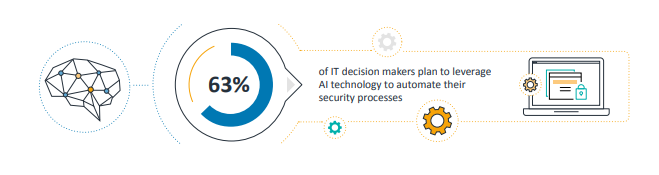

Pour lheure, lISF met à la disposition des entreprises membres le rapport « Demystifying Artificial Intelligence in Information Security » via son site web. 63 % des décideurs informatiques envisagent d'utiliser la technologie de l'intelligence artificielle pour automatiser leurs processus de sécurité, daprès ce rapport.

Source : ISF

Et vous ?

Que pensez-vous du rapport de lISF ?

Les cyberattaques soutenues par lIA font-elles courir un réel danger à la sécurité de linformation des organisations ?

Lire aussi

Pour Elon Musk l'IA est bien plus dangereuse que l'arme nucléaire, alors que Bill Gates estime que l'IA est à la fois porteuse d'espoir et dangereuse

L'IA représenterait un plus grand risque pour l'humanité, que les changements climatiques et le terrorisme, selon un expert

L'apocalypse s'accomplira-t-elle avec la création de l'IA ? L'entrepreneur Elon Musk pense que l'IA est la plus grande menace de l'humanité

Trolldi : cinq dangers émanant de l'utilisation de l'intelligence artificielle et la robotique

Répondre avec citation

Répondre avec citation

) jusqu'à ce qu'il proclame que tu n'auras pas d'autres moyens de te connecter. Comme ça, ça leur fera un gros fichier plein de barbus

) jusqu'à ce qu'il proclame que tu n'auras pas d'autres moyens de te connecter. Comme ça, ça leur fera un gros fichier plein de barbus

Partager