Envoyé par

YouTube France

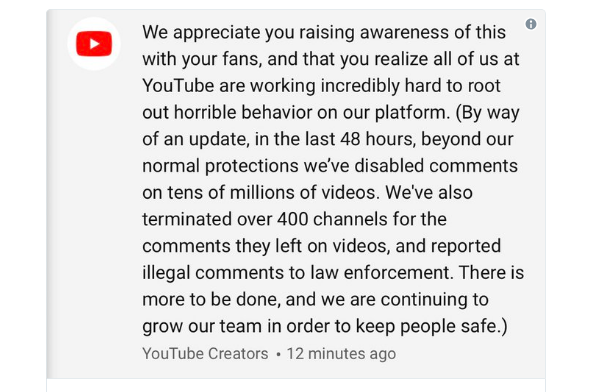

Tout contenu y compris les commentaires qui met en danger des mineurs est odieux et nous avons des règles claires les interdisant sur YouTube. Nous avons immédiatement pris les mesures correspondantes en supprimant des chaînes et des comptes, en signalant toute activité illégale aux autorités et en désactivant les commentaires sur des dizaines de millions de vidéos incluant des mineurs. Il reste encore des choses à faire et nous continuons à travailler pour améliorer notre dispositif et être encore plus rapide pour appréhender ces abus.

Pour ce qui est de la monétisation, voici les mesures prises

Les vidéos incluant des mineurs et qui sont susceptibles d'être commentéees par des prédateurs recevront peu ou même pas de publicité (icône jaune). Si en tant qu'utilisateur vous pensez que nous avons commis une erreur, vous pouvez soumettre une demande d'examen. Nous continuerons daffiner notre approche dans les semaines et les mois à venir. Nous avons immédiatement pris les mesures nécessaires au-delà de ce qui avait été signalé. Au cours des dernières 48 heures, nous avons : adopté une approche agressive et désactivé les commentaires sur des dizaines de millions de vidéos incluant des mineurs, ce, au-delà de nos protections habituelles ; examiné et supprimé des milliers de commentaires inappropriés associés à des vidéos incluant des mineurs ; mis fin à plus de 400 chaînes à cause des commentaires laissés sur des vidéos et signalé les commentaires illégaux au National Center foc Missing and Exploited Children (NCMEC) afin qu'ils puissent travailler avec les autorités compétentes ; supprimé des dizaines de vidéos mises en ligne avec des intentions légitimes, mais mettant clairement des mineurs en danger. Nous travaillons également en étroite collaboration avec des organisations telles que Point de Contact en France ou la Internet Watch Foundation au Royaume-Uni.

Actions entreprises au quotidien pour lutter contre les prédateurs

Nous nous sommes toujours engagés à uvrer au sein de lindustrie pour lutter contre ce genre de contenus horribles avec, notamment, le développement de technologies de pointe comme notre outil CSAI. Nous investissons continuellement dans les nouvelles technologies et les mettons gratuitement à la disposition des autres acteurs du numérique. Nous sommes fiers que notre travail avec le NCMEC ait pu conduire à des arrestations et à des condamnations. L'année dernière, nous avons ainsi supprimé et signalé 46 000 comptes au NCMEC via YouTube. En complément, nous recrutons régulièrement des experts dédiés à la sécurité des enfants, notamment, des travailleurs sociaux, des spécialistes du développement de l'enfant, des salariés du NCMEC, d'anciens procureurs et d'anciens membres du FBI et de la CIA. Nous ne cesserons jamais nos efforts et allons continuer de développer nos équipes dédiées à la sécurité des mineurs.

Suppression de comptes d'utilisateurs de moins de 13 ans

De manière générale, nos conditions d'utilisation n'autorisent pas les utilisateurs de moins de 13 ans (l'âge peut varier dans certains pays) à créer ou à posséder un compte sur YouTube. Dans les cas où nous identifions un compte géré par une personne en dessous de cette limite d'âge, nous le redirigeons vers notre processus dexamen des comptes de mineurs. Le compte est résilié ou le propriétaire est invité à vérifier juridiquement que le titulaire du compte a dépassé l'âge limite. S'ils ne sont pas en mesure de fournir ces informations, nous prenons les mesures nécessaires pour mettre fin aux comptes YouTube et Google de l'utilisateur, ce, conformément à nos conditions d'utilisation. Nous supprimons des milliers de comptes chaque semaine dans le cadre de ce processus.

En complément, je vous invite à parcourir notre dernier rapport détaillant les nombreuses actions mises en uvre pour garantir lapplication de notre règlement de la communauté. Ainsi, entre juillet et septembre 2018, YouTube a retiré 7,8 millions de vidéos. Parmi celles-ci, 81 % ont été détectées grâce à lapprentissage automatique. 74,5 % des vidéos identifiées par cette technologie ont été retirées avant quun utilisateur ne puisse les voir. Au total, 90 % des vidéos mises en lignes en septembre 2018 et supprimées pour extrémisme violent ou mise en danger d'un enfant ont été vues moins de 10 fois.

Concernant les commentaires

De juillet à septembre 2018, nos équipes ont supprimé plus de 224 millions de commentaires pour violation du règlement en vigueur sur la plateforme. Pour rappel, l'année dernière, Google a porté à 10 000 le nombre de personnes chargées au sein de l'entreprise de lutter contre les contenus susceptibles de violer nos conditions d'utilisation.

Qu'en pensez-vous ?

Pensez-vous que YouTube devrait être tenu pour responsable ?

YouTube bannit les vidéos incitant à des activités dangereuses à cause du défi Bird Box qui a eu de graves conséquences chez des participants

YouTube travaille à restaurer les vidéos bloquées de plusieurs chaînes parmi lesquelles celle du MIT et de la fondation Blender

Blocage de vidéos : YouTube voudrait-il forcer les chaînes populaires à accepter la publicité ? Le président de la Fondation Blender s'interroge

Répondre avec citation

Répondre avec citation

Partager