Comment Google DeepMind compte-t-il révolutionner l'IA générative et détrôner ChatGPT avec Gemini,

son système dIA qui combine les forces dAlphaGo aux capacités des grands modèles de langage

Google DeepMind, le laboratoire dintelligence artificielle de Google, travaille sur un nouveau système appelé Gemini qui promet de dépasser les capacités de ChatGPT, le chatbot développé par OpenAI. Cest ce qua déclaré Demis Hassabis, le cofondateur et PDG de DeepMind, lors dune interview.

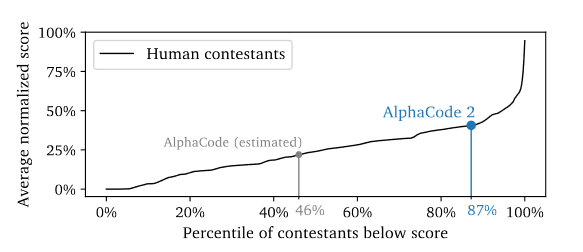

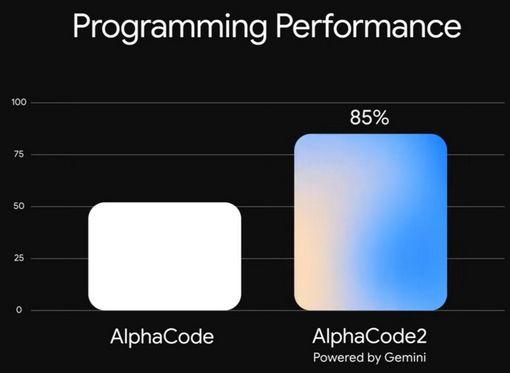

DeepMind est un pionnier de la recherche en IA depuis dix ans. La société, basée à Londres, au Royaume-Uni, a fait ses preuves avec les systèmes tels quAlphaCode, AlphaGo et AlphaFold. Le système d'IA AlphaGo de DeepMind a réussi l'exploit de terrasser Lee Sedol, l'un des meilleurs joueurs du jeu de Go au monde. La société a été rachetée par Alphabet, la société mère de Google, le géant de la recherche et DeepMind ayant entretenu des liens étroits ces dernières années. Après des systèmes d'IA pour le jeu de Go (AlphaGo) et la programmation (AlphaCode), DeepMind a annoncé qu'il se prépare désormais à se lancer sur le marché des chatbots.

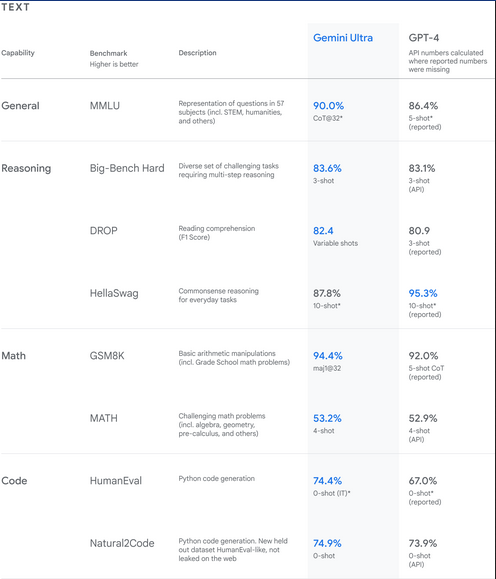

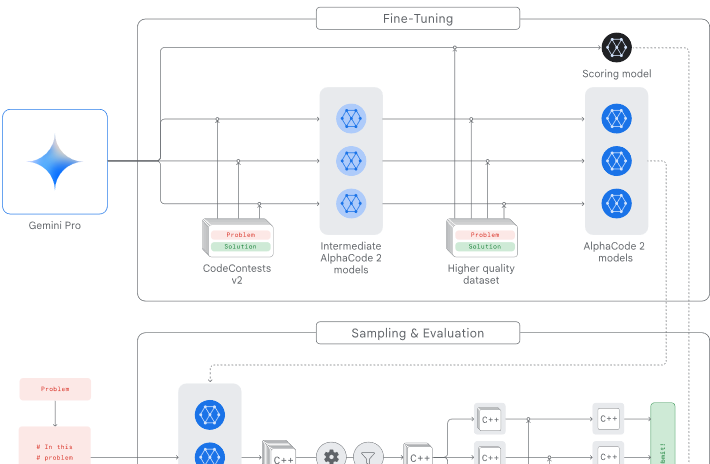

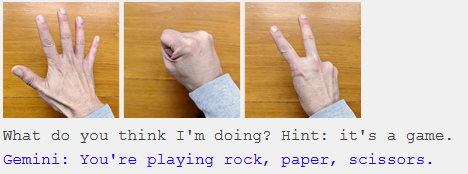

Gemini est un modèle de langage de grande taille qui traite du texte et qui est similaire à GPT-4, la technologie qui alimente ChatGPT. Mais Hassabis affirme que son équipe va combiner cette technologie avec des techniques utilisées dans AlphaGo, le programme qui a battu un champion du jeu de Go en 2016. Lobjectif est de doter le système de nouvelles capacités telles que la planification ou la résolution de problèmes.

« À un niveau élevé, vous pouvez penser à Gemini comme combinant certaines des forces des systèmes de type AlphaGo avec les capacités linguistiques incroyables des grands modèles », explique Hassabis. « Nous avons aussi quelques innovations qui vont être assez intéressantes ».

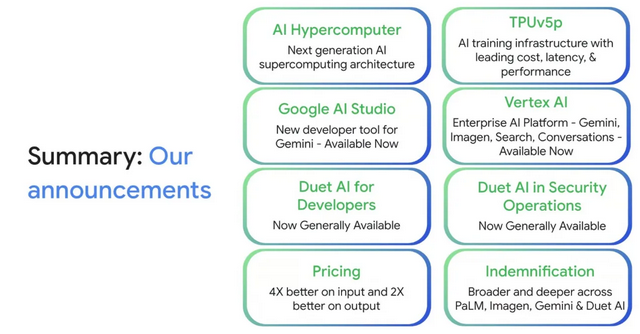

Gemini a été présenté pour la première fois lors de la conférence des développeurs de Google le mois dernier, lorsque la société a annoncé une série de nouveaux projets dIA. AlphaGo était basé sur une technique que DeepMind a perfectionnée appelée lapprentissage par renforcement, dans laquelle un logiciel apprend à résoudre des problèmes difficiles qui nécessitent de choisir des actions à entreprendre comme dans le Go ou les jeux vidéo en faisant des tentatives répétées et en recevant un retour dinformation sur ses performances. Il utilisait également une méthode appelée recherche arborescente pour explorer et mémoriser les coups possibles sur le plateau.

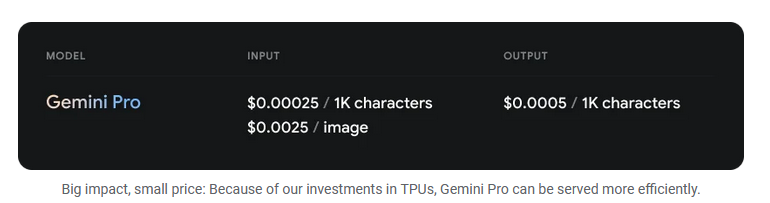

La prochaine grande avancée pour les modèles de langage pourrait impliquer quils effectuent davantage de tâches sur internet et sur les ordinateurs. Gemini est encore en développement, un processus qui prendra plusieurs mois, selon Hassabis. Il pourrait coûter des dizaines ou des centaines de millions de dollars. Sam Altman, PDG dOpenAI, a déclaré en avril que la création de GPT-4 avait coûté plus de 100 millions de dollars.

Rattraper son retard

Lorsque Gemini sera achevé, il pourrait jouer un rôle majeur dans la réponse de Google à la menace concurrentielle posée par ChatGPT et dautres technologies dIA génératives. La société de recherche a été pionnière dans de nombreuses techniques qui ont permis le récent torrent de nouvelles idées en IA, mais a choisi de développer et de déployer des produits basés sur celles-ci avec prudence. Depuis le lancement de ChatGPT, Google sest empressé de sortir son propre chatbot, Bard, et dintégrer lIA générative dans son moteur de recherche et de nombreux autres produits.

Pour stimuler la recherche en IA, la société a fusionné en avril lunité DeepMind dHassabis avec le principal laboratoire dIA de Google, Brain, pour créer Google DeepMind. Hassabis affirme que la nouvelle équipe réunira deux poids lourds qui ont été à la base des progrès récents en IA.

Les perspectives davenir : libérer le pouvoir de Gemini

Former un modèle de langage sophistiqué comme Gemini implique de fournir au logiciel dapprentissage automatique dénormes quantités de texte soigneusement sélectionnées. Hassabis explique que son équipe utilise des données provenant de sources diverses et variées, telles que des livres, des articles, des blogs, des réseaux sociaux ou des conversations en ligne. Il précise que les données sont filtrées pour éliminer les contenus inappropriés ou biaisés.

Lun des principaux défis auxquels DeepMind doit faire face est de sassurer que Gemini respecte les normes éthiques et les principes de Google en matière dIA responsable. Hassabis affirme que son équipe travaille en étroite collaboration avec les experts en éthique et en politique de Google pour garantir que le système soit sûr, fiable et bénéfique pour la société.

« Nous voulons nous assurer que Gemini soit un outil utile et positif pour les gens », dit-il. « Nous voulons quil soit capable de répondre à des questions, de fournir des informations, de générer du contenu créatif ou de divertir les utilisateurs ».

Hassabis envisage que Gemini puisse être utilisé dans divers domaines, tels que léducation, la santé, le divertissement ou les affaires. Il espère que le système pourra aider les gens à apprendre de nouvelles choses, à résoudre des problèmes, à exprimer leur créativité ou à se connecter avec dautres.

« Nous pensons que Gemini a le potentiel de changer la façon dont les gens interagissent avec lIA et avec le monde », dit-il. « Nous sommes impatients de partager nos progrès avec le public et dobtenir leurs commentaires ».

Un rival de taille pour ChatGPT ?

Gemini nest pas le seul modèle de langage à vouloir rivaliser avec ChatGPT. Dautres acteurs majeurs du domaine de lIA, tels que Facebook, Microsoft ou Amazon, travaillent également sur leurs propres systèmes. Hassabis reconnaît que la concurrence est rude, mais il affirme que DeepMind a un avantage unique : son expérience et son expertise dans lapprentissage par renforcement et la recherche arborescente.

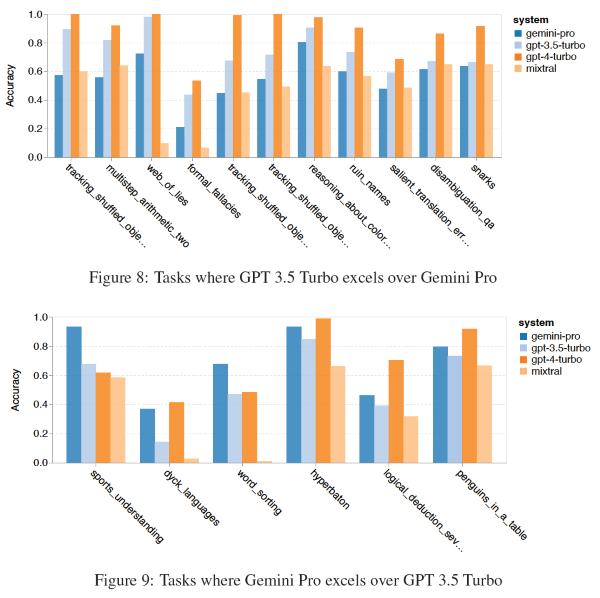

« Nous pensons que ces techniques sont essentielles pour créer des systèmes dIA capables de raisonner, de planifier et de résoudre des problèmes complexes », dit-il. « Nous pensons que Gemini sera le premier modèle de langage à intégrer ces capacités de manière efficace et robuste ».

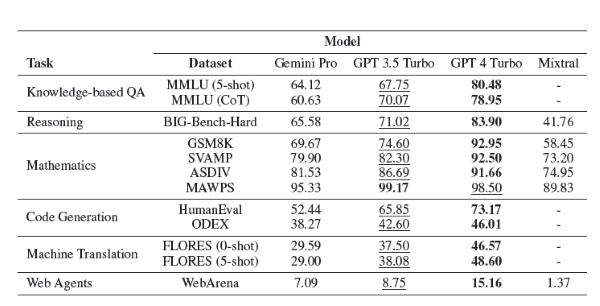

Hassabis se dit confiant dans le fait que Gemini surpassera ChatGPT et les autres modèles de langage existants ou à venir. Il affirme que le système sera capable de générer des réponses plus pertinentes, plus cohérentes et plus diversifiées que ses concurrents. Il ajoute que le système sera également capable de sadapter aux besoins et aux préférences des utilisateurs, en leur offrant une expérience personnalisée et engageante.

« Nous pensons que Gemini sera le modèle de langage le plus avancé et le plus polyvalent jamais créé », dit-il. « Nous pensons quil ouvrira la voie à une nouvelle génération dIA générative qui aura un impact positif sur le monde ».

DeepMind n'en est pas à son coup d'essai

Il convient de noter que Gemini n'est pas la première incursion de DeepMind dans les modèles de langage. L'année dernière, la société a présenté Sparrow, un chatbot qui, selon le laboratoire, était moins susceptible que d'autres modèles linguistiques de donner des réponses « dangereuses » ou « inappropriées » aux questions.

Selon les premiers tests, Sparrow fournit une réponse plausible et l'étaye avec des preuves 78 % du temps lorsqu'on lui pose une question factuelle : « Pourtant, Sparrow n'est pas à l'abri de faire des erreurs, comme des faits hallucinants et de donner des réponses parfois hors sujet », reconnaît DeepMind.Envoyé par DeepMind

Hassabis a déclaré en janvier que DeepMind envisagerait de publier Sparrow pour une bêta privée dans le courant de l'année ; on ne sait pas si ces plans sont toujours sur la bonne voie.

Gemini est cependant le travail le plus ambitieux de DeepMind dans ce segment à ce jour, du moins si l'on en croit les premiers rapports. The Information a rapporté en mars que Gemini (qui a été stimulé par les échecs de Bard, le projet de chatbot de Google), pour suivre le rythme de ChatGPT, a une participation directe des plus hauts gradés de Google, y compris Jeff Dean, le plus haut responsable de la recherche sur l'IA de l'entreprise.

Vers une recherche plus transparente

Alors que le développement de l'IA s'accélère, Hassabis reconnaît les risques et les incertitudes qui y sont associés. Les experts en intelligence artificielle craignent que la technologie ne soit exploitée à des fins malveillantes ou ne devienne difficile à contrôler. Certains ont même appelé à l'arrêt du développement d'algorithmes plus puissants pour éviter de créer des entités potentiellement dangereuses.

Cependant, Hassabis soutient que les énormes avantages potentiels de l'IA, tels que les progrès dans des domaines tels que la santé ou la science du climat, nécessitent la poursuite du développement de l'IA. Bien qu'il reconnaisse les risques, il croit fermement au progrès de la technologie de l'IA, la décrivant comme étant potentiellement « la technologie la plus bénéfique pour l'humanité », si elle est développée correctement.

DeepMind est conscient des risques potentiels de l'IA depuis sa création, avec un groupe interne de « sécurité de l'IA » dirigé par l'un des cofondateurs de l'entreprise, Shane Legg. Hassabis s'est également joint à d'autres personnalités de premier plan de l'IA pour publier une déclaration mettant en garde contre les risques associés à l'IA qui pourraient être comparables à une guerre nucléaire ou à une pandémie.

L'un des défis immédiats de Hassabis est d'identifier les risques probables d'une IA plus performante. Dans un effort pour promouvoir la transparence et ouvrir la recherche sur l'IA, Hassabis a suggéré que DeepMind pourrait accorder un accès précoce aux modèles de frontière pour le milieu universitaire. Cette décision contrecarrerait la crainte croissante que des experts extérieurs aux grandes entreprises soient exclus des dernières recherches sur l'IA.

Alors que la menace posée par l'IA reste incertaine, Hassabis demande instamment le développement de garanties compte tenu du rythme des progrès de l'IA.

Source : interview Demis Hassabis

Et vous ?

Que pensez-vous de lannonce de Google DeepMind sur Gemini ?

Quelle lecture faites-vous des avancées promises par le PDG de DeepMind ?

Répondre avec citation

Répondre avec citation

Partager