Deepfake : l'app gratuite Zao vous permet de changer le visage d'un personnage de film par le vôtre,

après avoir téléchargé une photo

Une application chinoise qui permet aux utilisateurs de changer de manière convaincante le visage d'un personnage de films ou de chaînes de télévision par leur visage est rapidement devenue lune des applications les plus téléchargées du pays, déclenchant une série de questions relatives à la confidentialité. Lancée vendredi 30 août, l'application Zao serait devenue lapplication gratuite la plus téléchargée en Chine daprès la société danalyses App Annie.

Les utilisateurs chinois ont saisi l'opportunité de se voir jouer des scènes de films connus utilisant la technologie deepfake, ce qui a déjà suscité des inquiétudes au sujet d'un éventuel abus.

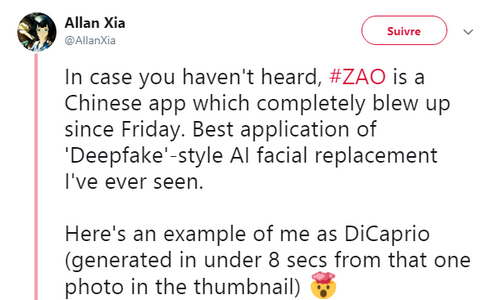

Allan Xia, utilisateur de Twitter, a publié une démonstration détaillée de ce que l'application est capable de faire avec un clip de 30 secondes de son visage remplaçant celui de Leonardo Dicaprio lors de moments célèbres de plusieurs de ses films. Selon Xia, les clips ont été générés en moins de huit secondes à partir d'une seule photo. Cependant, Bloomberg note que l'application peut également vous guider tout au long du processus de prise d'une série de photographies (où elle vous demandera d'ouvrir et de fermer la bouche, de cligner des yeux, d'arborer des expressions faciales) pour générer des résultats plus réalistes.

En somme, les utilisateurs fournissent une série de selfies que lapplication utilise pour transformer de façon réaliste un personnage dans un film, une émission de télévision ou dautres contenus.

Selon Xia, l'application ne propose qu'un nombre limité de clips dans lesquels vous pouvez insérer votre visage. Le développeur de lapplication a probablement formé ses algorithmes sur chacun de ces clips pour remodeler facilement le visage de lutilisateur sur eux, comme le spécule Xia. L'application ne peut pas mapper votre visage sur un clip vidéo de votre choix.

La technologie ressemble à ce qu'ont montré récemment des chercheurs de lImperial College de Londres, qui ont présenté une technologie capable de transformer une photo unique en portrait chantant. La différence ici est que Zao insère votre image dans une vidéo existante, plutôt que danimer directement une photo de vous. Néanmoins, cela montre à quel point la technologie sous-jacente a évolué rapidement : ce qui nécessitait autrefois des centaines dimages pour créer une vidéo deepfake plutôt convaincante ne nécessite désormais plus quune seule image avec de meilleurs résultats.

Des conditions d'utilisation qui inquiètent

La société a été obligée de publier dimanche une déclaration dans laquelle elle annonçait des modifications après que les critiques eurent attaqué la politique de confidentialité de l'application, qui disposait de droits « gratuits, irrévocables, permanents, transférables et dont la licence peut être reconduite » sur tout contenu généré par l'utilisateur.

Les deepfakes, qui utilisent l'intelligence artificielle pour paraître authentiques, suscitent de plus en plus d'inquiétudes. Les critiques disent que la technologie peut être utilisée pour créer de fausses vidéos permettant de manipuler des élections, de diffamer quelqu'un ou de potentiellement e causer des troubles en diffusant des informations erronées à grande échelle.

« Nous comprenons les préoccupations concernant la vie privée. Nous avons reçu les commentaires et nous allons régler les problèmes que nous navons pas pris en compte, ce qui prendra un certain temps », a déclaré Zao. Zao appartient à Momo Inc, un service de rencontres apparenté à Tinder qui est coté au Nasdaq américain. Momo Inc a déjà été épinglée en 2014 pour une faille de sécurité. Les mots de passe et données de 30 millions dutilisateurs dune application de rencontres quil détenait avaient alors été exposés. Le spécialiste du numérique Baptiste Robert (alias Elliot Alderson) a d'ailleurs émis des doutes sur la sécurité du stockage des données en ligne : il serait assez simple daccéder aux photos et montages laissés par des utilisateurs, sans mot de passe. Il suffirait pour ceci davoir le lien vers limage en question.

Depuis, l'entreprise a changé ses termes. Elle s'est par exemple engagée à supprimer de ses serveurs tout contenu téléchargé, mais supprimé ultérieurement par les utilisateurs.

Cest une controverse similaire à celle qui a entouré FaceApp plus tôt cette année, lorsque lapplication qui permettait aux utilisateurs de voir à quoi ils ressembleraient plus vieux est redevenue virale en juillet. Le développeur de lapplication a été contraint de clarifier sa politique de confidentialité et doffrir aux utilisateurs la possibilité de supprimer leurs photos de leurs serveurs sils le souhaitaient. Dans le cas de FaceApp, les commentateurs ont rapidement souligné que la politique de confidentialité de lapplication nétait pas plus envahissante que la plupart des applications mobiles les plus populaires à travers le monde.

Les manifestants à Hong Kong s'efforcent de se couvrir le visage de peur que la police utilise la technologie de reconnaissance faciale pour identifier et arrêter des cibles. Dans certaines zones du monde, les gens sont de plus en plus conscients de limportance de leurs données dimagerie faciale et sinquiètent à juste titre des entreprises qui ne prennent pas les mesures de protection adéquates pour les protéger.

Toutefois, cela n'a pas entamé la popularité de l'application qui est restée en tête des applications de téléchargement gratuit en Chine lundi soir, selon App Annie.

Source : Allan Xia, Zao (via Weibo), Radii, Elliot Anderson

Et vous ?

Que pensez-vous de cette application ? Êtes-vous tenté de l'essayer ?

Quel serait, selon vous, le pire scénario qui puisse arriver ?

Faut-il craindre les deepfake en général ?

Voir aussi :

Des chercheurs ont mis au point un algorithme pour détecter les deepfakes en divisant l'image en de petites zones pour les examiner pixel par pixel

Des utilisateurs s'inquiètent des risques potentiels sur la vie privée apportés par FaceApp, l'app qui permet d'appliquer un filtre vieillissant

GitHub supprime de sa plateforme les versions open source de DeepNude, l'application qui crée des images de femmes nues en quelques secondes

Une nouvelle application deepfake générée par l'IA créé des images de femmes nues en quelques secondes, elle est maintenant supprimée de l'Internet

Répondre avec citation

Répondre avec citation

Partager