Google lance Gemini 1.5, une semaine après Gemini Ultra 1.0

« Gemini 1.5 Pro atteint une qualité comparable à 1.0 Ultra, tout en utilisant moins de calcul », explique le PDG Sundar Pichai

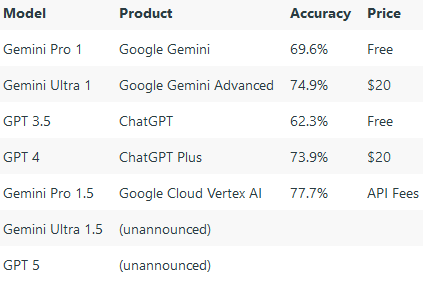

Une semaine après sa dernière annonce majeure en matière d'IA, Google semble s'être surpassé. Jeudi de la semaine dernière, Google a lancé Gemini Ultra 1.0, qui était censé représenter le meilleur modèle de langage d'IA que Google pouvait rassembler - disponible dans le cadre de l'assistant d'IA rebaptisé "Gemini" (anciennement Bard). Cette fois-ci, Google annonce Gemini Pro 1.5, qui, selon la société, « atteint une qualité comparable à celle de 1.0 Ultra, tout en utilisant moins de ressources informatiques ».

Deux mois à peine après le lancement de Gemini, le grand modèle de langage sur lequel Google mise pour se hisser au sommet de l'industrie de l'IA, l'entreprise annonce déjà son successeur. Google a présenté Gemini 1.5 et le met à la disposition des développeurs et des utilisateurs professionnels, avant de le proposer prochainement au grand public. L'entreprise a clairement indiqué qu'elle souhaitait faire de Gemini un outil professionnel, un assistant personnel et tout ce qui se trouve entre les deux, et qu'elle met tout en uvre pour atteindre cet objectif.

Gemini 1.5 comporte de nombreuses améliorations : Gemini 1.5 Pro, le modèle polyvalent du système de Google, est apparemment au même niveau que le Gemini Ultra haut de gamme que l'entreprise n'a lancé que récemment, et il a surpassé Gemini 1.0 Pro dans 87 % des tests de référence. Il a été réalisé à l'aide d'une technique de plus en plus courante appelée "Mixture of Experts" (MoE), ce qui signifie qu'il n'exécute qu'une partie du modèle global lorsque vous envoyez une requête, plutôt que de traiter l'ensemble du modèle en permanence (cette approche devrait rendre le modèle plus rapide pour vous et plus efficace pour Google).

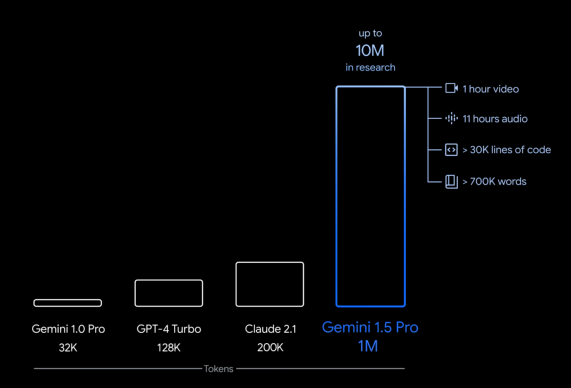

Mais il y a une nouveauté dans Gemini 1.5 qui enthousiasme toute l'entreprise, à commencer par le PDG Sundar Pichai : Gemini 1.5 dispose d'une énorme fenêtre contextuelle, ce qui signifie qu'il peut traiter des requêtes beaucoup plus importantes et examiner beaucoup plus d'informations à la fois. Cette fenêtre est d'un million de jetons, contre 128 000 pour la GPT-4 d'OpenAI et 32 000 pour la version actuelle de Gemini Pro. Les jetons sont une mesure difficile à comprendre, c'est pourquoi Pichai simplifie : « Cela représente environ 10 ou 11 heures de vidéo, des dizaines de milliers de lignes de code ». La fenêtre contextuelle permet d'interroger l'intelligence artificielle sur l'ensemble de ce contenu en une seule fois.

Envoyé par Sundar Pichai

Un « saut générationnel », selon les chercheurs de Google

« Gemini 1.5 Pro permet d'obtenir un rappel [ndlr. "recall" en anglais, qui est la capacité d'un modèle à trouver tous les cas pertinents dans un ensemble de données] presque parfait sur les tâches de recherche en contexte long dans toutes les modalités, améliore l'état de l'art en matière d'assurance qualité des documents longs, d'assurance qualité des vidéos longues et d'ASR en contexte long, et égale ou dépasse les performances de pointe de Gemini 1.0 Ultra sur un large éventail de points de référence », écrivent les chercheurs de Google dans un document technique sur Gemini 1.5 Pro.

En d'autres termes, lorsqu'on lui présente un long document à assimiler - jusqu'à 10 millions de jetons - Gemini 1.5 peut répondre de manière appropriée à une requête spécifique dans plus de 99 % des cas. Selon les chercheurs de Google, la capacité de 10 millions de jetons de Gemini représente « un saut générationnel par rapport aux modèles existants tels que Claude 2.1 et GPT-4 Turbo, qui pour l'instant plafonnent respectivement à 200 000 et 128 000 jetons ».

« Le modèle Gemini Ultra surpasse actuellement toutes les alternatives existantes sur un large éventail de tests de référence », a déclaré François Chollet, créateur de Keras et ingénieur logiciel chez Google, dans un billet en ligne. « Google dispose d'un mécanisme de filtrage des jeux de tests de pointe qui n'a pas d'équivalent à l'extérieur, de sorte que les tests de référence surestiment probablement d'autres modèles ».

Citant ces tests, Jeff Dean, scientifique en chef chez Google DeepMind et Google Research, a déclaré dans un message en ligne : « Pour le texte, Gemini 1.5 Pro atteint 100 % de rappel jusqu'à 530k tokens, 99,7 % jusqu'à 1M tokens et 99,2 % de précision jusqu'à 10M tokens ».More broadly: the Gemini Ultra model currently beats all existing alternative on a broad range of benchmarks -- and that's with Google having a state-of-the-art test set filtering mechanism that is unmatched externally, so the benchmarks are likely overestimating other models.

François Chollet (@fchollet) February 9, 2024

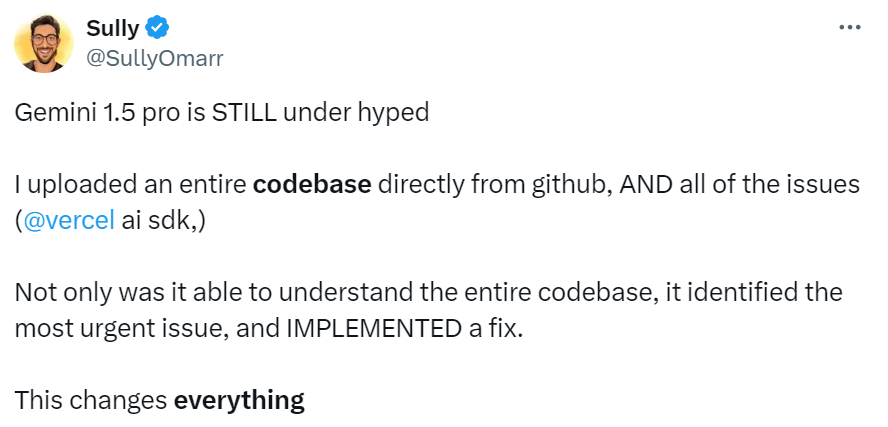

La grande capacité de Gemini 1.5 Pro lui permet de réaliser des exploits tels que l'ingestion de la transcription de 402 pages du vol Apollo 11 (326 914 jetons) puis, lorsqu'on le lui demande, de trouver « trois moments comiques » dans les échanges entre les astronautes d'Apollo 11 et d'identifier le texte de la transcription qui correspond à un croquis dessiné à la main d'une botte marchant sur la surface lunaire.Needle in a Haystack tests

Jeff Dean (@🏡) (@JeffDean) February 15, 2024

The tech report also details a number of microbenchmark needle in a haystack tests (modeled after @GregKamradts https://t.co/Hms5EalX1L) that probe the models ability to retrieve specific information from its context.

For text, Gemini 1.5 Pro pic.twitter.com/75isTIRCsg

Lors de l'alimentation de Sherlock Jr, un film de 45 minutes de Buster Keaton datant de 1924 (2 674 images à 1FPS, 684K jetons), Gemini 1.5 Pro a répondu à l'invite « Donne-moi quelques informations clés sur le morceau de papier qui est retiré de la poche de la personne, et le timecode de ce moment » en récitant le texte de la note dans le film et l'heure à laquelle la scène s'est déroulée.

Google offre gratuitement aux développeurs et aux entreprises clientes un aperçu limité de Gemini 1.5 Pro avec une fenêtre contextuelle de 1 million de jetons par l'intermédiaire de ses services AI Studio et Vertex AI. La disponibilité générale avec une fenêtre contextuelle de 128K jetons sera annoncée ultérieurement, de même que la structure de prix de la méga-entreprise.

Fiche technique : le meilleur modèle de codage existant ?

Pour ceux qui souhaitent se plonger dans les détails techniques, Google a publié un rapport technique sur Gemini 1.5 qui semble montrer que Gemini est plus performant que GPT-4 Turbo sur diverses tâches, mais il est également important de noter que la sélection et l'interprétation de ces benchmarks peuvent être subjectives. Le rapport donne quelques chiffres sur l'amélioration de la version 1.5 par rapport à la version 1.0, indiquant qu'elle est 28,9 % plus performante que la version 1.0 Pro en « mathématiques, sciences et raisonnement » et 5,2 % plus performante dans ces domaines que la version 1.0 Ultra.

Selon natrual2code, Gemini 1.5 Pro dispose de la meilleure précision en codage :

Les points saillants de Gemini 1.5

Google a noté les points forts de la nouvelle version. Ci-dessous un extrait de son communiqué :

Une architecture très efficace

Gemini 1.5 s'appuie sur nos recherches de pointe en matière d'architecture Transformer et MoE. Alors qu'un transformateur traditionnel fonctionne comme un grand réseau neuronal, les modèles MoE sont divisés en réseaux neuronaux "experts" plus petits.

En fonction du type d'entrée, les modèles MoE apprennent à activer de manière sélective les voies expertes les plus pertinentes de leur réseau neuronal. Cette spécialisation améliore considérablement l'efficacité du modèle. Google a été l'un des premiers adoptants et pionniers de la technique MoE pour l'apprentissage profond grâce à des recherches telles que Sparsely-Gated MoE, GShard-Transformer, Switch-Transformer, M4 et bien d'autres encore.

Nos dernières innovations en matière d'architecture de modèle permettent à Gemini 1.5 d'apprendre des tâches complexes plus rapidement et de maintenir la qualité, tout en étant plus efficace pour la formation et le service. Ces gains d'efficacité permettent à nos équipes d'itérer, de former et de fournir des versions plus avancées de Gemini plus rapidement que jamais, et nous travaillons à d'autres optimisations.

Plus de contexte, plus de capacités utiles

La "fenêtre contextuelle" d'un modèle d'IA est constituée de jetons, qui sont les éléments de base utilisés pour traiter les informations. Les jetons peuvent être des parties ou des sous-sections entières de mots, d'images, de vidéos, de sons ou de codes. Plus la fenêtre contextuelle d'un modèle est grande, plus il peut absorber et traiter d'informations dans une invite donnée, ce qui rend ses résultats plus cohérents, plus pertinents et plus utiles.

Grâce à une série d'innovations en matière d'apprentissage automatique, nous avons augmenté la capacité de la fenêtre contextuelle de 1.5 Pro bien au-delà des 32 000 jetons prévus à l'origine pour Gemini 1.0. Nous pouvons désormais utiliser jusqu'à 1 million de jetons en production.

Cela signifie que 1.5 Pro peut traiter de grandes quantités d'informations en une seule fois, y compris 1 heure de vidéo, 11 heures d'audio, des bases de code de plus de 30 000 lignes de code ou plus de 700 000 mots. Dans le cadre de nos recherches, nous avons également testé avec succès jusqu'à 10 millions de jetons.

Raisonnement complexe sur de grandes quantités d'informations

1.5 Pro est capable d'analyser, de classer et de résumer de grandes quantités d'informations dans un document donné. Par exemple, lorsqu'on lui donne les 402 pages de la transcription de la mission d'Apollo 11 sur la lune, il peut raisonner sur les conversations, les événements et les détails trouvés dans le document.

Une meilleure compréhension et un meilleur raisonnement entre les différentes modalités

1.5 Pro peut effectuer des tâches de compréhension et de raisonnement très sophistiquées pour différentes modalités, y compris la vidéo. Par exemple, lorsqu'on lui présente un film muet de 44 minutes de Buster Keaton, le modèle peut analyser avec précision les différents points de l'intrigue et les événements, et même raisonner sur de petits détails du film qui pourraient facilement passer inaperçus.

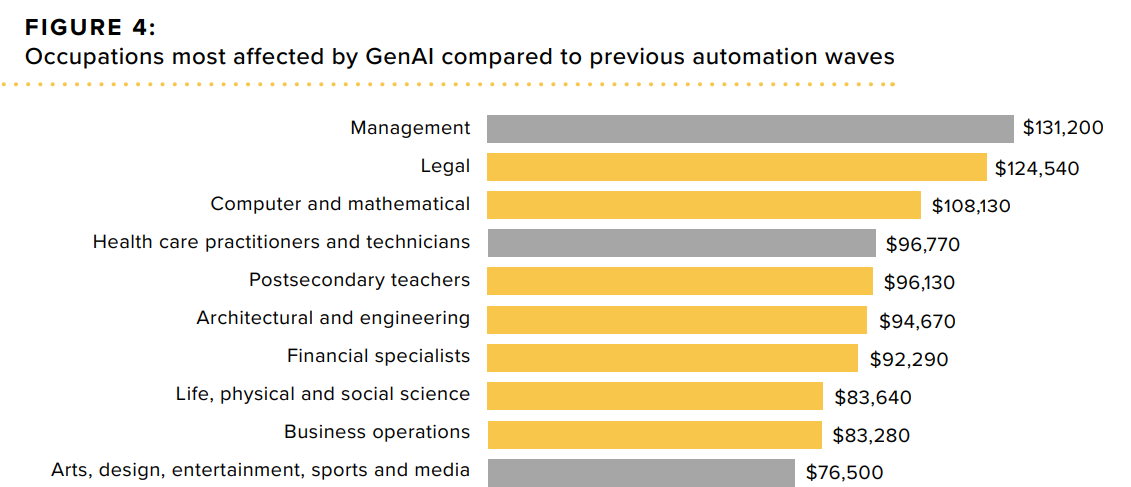

OpenAI dévoile de son côté Sora

Pour ne pas être en reste, OpenAI a dévoilé jeudi Sora, un modèle de conversion de texte en vidéo. À partir d'un texte, il crée une courte vidéo, d'une durée maximale d'une minute.

Selon l'entreprise, Sora peut générer des scènes complexes avec plusieurs personnages qui se déplacent et interagissent avec le monde dépeint de manière cohérente. Le super laboratoire a tweeté des exemples de sa production.

Jim Fan, chercheur principal chez Nvidia, a décrit Sora comme un moteur physique piloté par les données et il suppose qu'il a été entraîné sur un grand nombre de données synthétiques provenant d'Unreal Engine 5 :Introducing Sora, our text-to-video model.

OpenAI (@OpenAI) February 15, 2024

Sora can create videos of up to 60 seconds featuring highly detailed scenes, complex camera motion, and multiple characters with vibrant emotions. https://t.co/7j2JN27M3W

Prompt: Beautiful, snowy pic.twitter.com/ruTEWn87vf

Si vous pensez que OpenAI Sora est un jouet créatif comme DALLE, ... détrompez-vous. Sora est un moteur physique piloté par des données. Il s'agit d'une simulation de nombreux mondes, réels ou fantastiques. Le simulateur apprend le rendu complexe, la physique "intuitive", le raisonnement à long terme et l'ancrage sémantique, le tout grâce au débruitage et aux mathématiques de gradient.

Je ne serais pas surpris que Sora soit entraîné sur de nombreuses données synthétiques à l'aide d'Unreal Engine 5. Il faut qu'il le soit !

Analysons la vidéo suivante. Invitation : « Vidéo photoréaliste en gros plan de deux bateaux pirates s'affrontant alors qu'ils naviguent à l'intérieur d'une tasse de café ».

- Le simulateur instancie deux actifs 3D exquis : des bateaux de pirates avec des décorations différentes. Sora doit résoudre le problème du passage du texte à la 3D de manière implicite dans son espace latent.

- Les objets 3D sont animés de manière cohérente lorsqu'ils naviguent et évitent les trajectoires des autres.

- La dynamique des fluides du café, et même les mousses qui se forment autour des navires. La simulation des fluides est un sous-domaine entier de l'infographie, qui nécessite traditionnellement des algorithmes et des équations très complexes.

- Photoréalisme, presque comme un rendu avec raytracing.

- Le simulateur tient compte de la petite taille de la tasse par rapport aux océans, et applique la technique du tilt-shift pour donner une impression de "minuscule".

- La sémantique de la scène n'existe pas dans le monde réel, mais le moteur met en uvre les règles physiques correctes que nous attendons.

Prochaine étape : ajouter d'autres modalités et conditionnements, et nous aurons alors une UE complète basée sur les données qui remplacera tous les pipelines graphiques conçus à la main.Sora n'est pas encore accessible au public car il doit encore subir des tests de sécurité.If you think OpenAI Sora is a creative toy like DALLE, ... think again. Sora is a data-driven physics engine. It is a simulation of many worlds, real or fantastical. The simulator learns intricate rendering, "intuitive" physics, long-horizon reasoning, and semantic grounding, all pic.twitter.com/pRuiXhUqYR

Jim Fan (@DrJimFan) February 15, 2024

« Le modèle actuel présente des faiblesses », a déclaré OpenAI dans un billet de blog. « Il peut avoir du mal à simuler avec précision la physique d'une scène complexe et peut ne pas comprendre des cas spécifiques de cause à effet. Par exemple, une personne peut prendre une bouchée d'un biscuit, mais après, le biscuit peut ne pas avoir de trace de morsure ».

Le modèle a également des difficultés avec les détails spatiaux (par exemple, distinguer la gauche de la droite) et n'est pas très à l'aise avec les descriptions qui décrivent des changements dans le temps.

Par conséquent, Sora est proposé aux "red teamers" qui testeront le modèle pour déterminer s'il est nuisible, ainsi qu'à divers artistes visuels afin d'obtenir un retour d'information sur la manière dont le modèle pourrait être utile dans le cadre de leur travail.

Selon OpenAI, une fois Sora intégré dans un produit public, « notre classificateur de texte vérifiera et rejettera les invites de saisie de texte qui sont en violation de nos politiques d'utilisation, comme celles qui demandent une violence extrême, un contenu sexuel, une imagerie haineuse, l'image d'une célébrité ou la propriété intellectuelle d'autrui ».

Sources : document technique sur Gemini 1.5 Pro, exemple d'analyse d'une transcription de 402 pages de la mission d'Apollo 11 sur la Lune, explication sur Mixture-of-Experts

Et vous ?

Quelle lecture faites-vous de Gemini 1.5 ? Que pensez-vous des performances annoncées par Google ?

Que pensez-vous de Sora ?

Répondre avec citation

Répondre avec citation

Partager