OpenAI supprime discrètement l'interdiction d'utiliser ChatGPT à des fins "militaires et de guerre", une décision lourde de conséquences à cause de l'utilisation croissante de l'IA dans les conflits.

OpenAI supprime l'interdiction des termes "militaire et guerre" de sa politique d'autorisation d'utilisation. "Compte tenu de l'utilisation de systèmes d'IA dans le ciblage des civils à Gaza, la décision de supprimer ces mots est un moment important", a averti un analyste politique.

Le fabricant de ChatGPT, OpenAI, a discrètement supprimé de sa politique d'utilisation les termes interdisant l'utilisation militaire de sa technologie, une décision qui a de sérieuses implications compte tenu de l'utilisation croissante de l'intelligence artificielle sur les champs de bataille, y compris à Gaza.

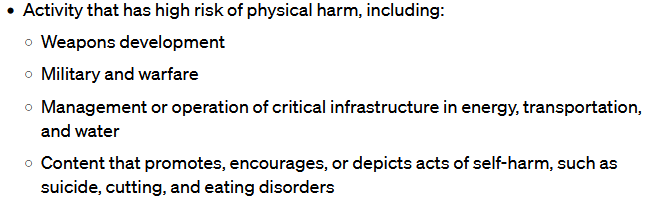

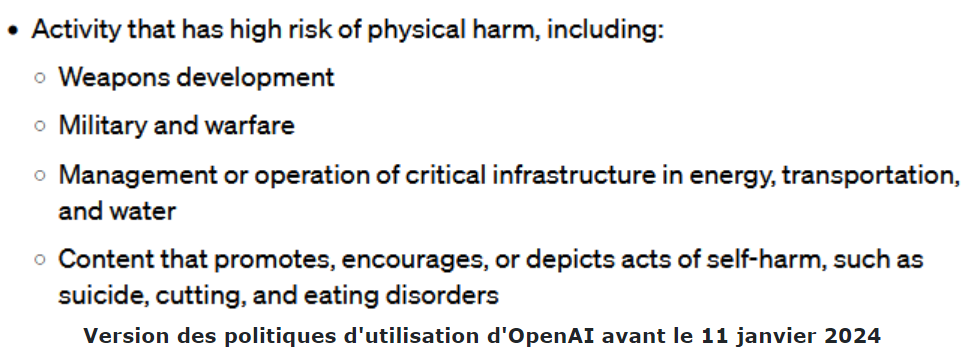

Sam Biddle, de The Intercept, a rapporté qu'avant le 10 janvier, la page d'autorisation d'utilisation d'OpenAI interdisait les "activités présentant un risque élevé de dommages physiques", notamment "le développement d'armes" et "l'armée et la guerre".

Bien que la nouvelle politique de l'entreprise stipule que les utilisateurs ne doivent pas nuire à des êtres humains ou "développer ou utiliser des armes", les experts ont déclaré que la suppression des termes "militaire et guerre" laisse la porte ouverte à des contrats lucratifs avec l'armée américaine et d'autres armées.

"Compte tenu de l'utilisation de systèmes d'IA dans le ciblage des civils à Gaza, la décision de supprimer les termes "militaire et de guerre" de la politique d'autorisation d'utilisation d'OpenAI est un moment important", a déclaré à The Intercept Sarah Myers West, directrice générale de l'AI Now Institute et ancienne analyste de la politique en matière d'IA à la Federal Trade Commission. "Le langage utilisé dans la politique reste vague et soulève des questions sur la manière dont OpenAI entend aborder l'application de la loi", a-t-elle ajouté.

Niko Felix, porte-parole d'OpenAI, a déclaré à The Intercept que l'entreprise "visait à créer un ensemble de principes universels qui soient à la fois faciles à retenir et à appliquer, d'autant plus que nos outils sont désormais utilisés à l'échelle mondiale par des utilisateurs quotidiens qui peuvent également construire des TPG". 'Un principe tel que "ne pas nuire à autrui" est large mais facile à comprendre et pertinent dans de nombreux contextes", a ajouté M. Felix. "En outre, nous avons spécifiquement cité les armes et les blessures infligées à autrui comme des exemples clairs."

Les progrès de l'IA s'accompagnent d'une militarisation croissante. Les experts avertissent que les applications de l'IA, y compris les systèmes d'armes autonomes létaux, communément appelés "robots tueurs", pourraient constituer une menace potentiellement existentielle pour l'humanité, ce qui souligne la nécessité de prendre des mesures de contrôle des armements pour ralentir le rythme de l'arsenalisation.

Tel est l'objectif de la législation sur les armes nucléaires présentée l'année dernière au Congrès américain. La loi bipartisane "Block Nuclear Launch by Autonomous Artificial Intelligence Act", présentée par le sénateur Ed Markey (D-Mass.) et le représentant Ted Lieu (D-Calif.), a été adoptée par le Congrès l'année dernière. Ted Lieu (D-Calif.), Don Beyer (D-Va.) et Ken Buck (R-Colo.) - affirme que "toute décision de lancer une arme nucléaire ne devrait pas être prise" par l'IA.

Sources : Sam Biddle (The Intercept), Politique d'autorisation d'utilisation (OpenAI)

Et vous ?

Pensez-vous que ce changement dans la politique d'autorisation d'utilisation d'OpenAI est crédible ou pertinent ?

Quel est votre avis sur le sujet ?

Voir aussi :

Les États-Unis commencent à étudier la possibilité de réglementer les systèmes d'IA comme ChatGPT pour garantir que ces technologies soient légales, efficaces, éthiques, sûres et dignes de confiance

Intelligence artificielle et armement : les présidents Joe Biden et Xi Jinping s'engagent à interdire l'IA dans les armes autonomes, telles que les drones et le contrôle des ogives nucléaires

Israël utilise des essaims de drones autonomes pour traquer et anéantir le Hamas sans intervention humaine : L'IA doit-elle avoir le droit de vie ou de mort sur le champ de bataille ?

Répondre avec citation

Répondre avec citation

Partager