Les grands modèles de langage (LLM) sont désormais capables d'ignorer des informations non pertinentes grâce à la nouvelle technique "System 2 Attention" (S2A) introduite par Meta

S'il est une chose qui freine les grands modèles de langage malgré les progrès considérables qu'ils ont réalisés au cours de l'année écoulée, c'est bien leur manque de compétences en matière de raisonnement. La résolution de problèmes est généralement considérée comme le talon d'Achille d'un LLM, et cela peut l'empêcher d'atteindre son véritable potentiel. Cependant, une nouvelle technique est apparue qui pourrait permettre d'affiner leurs capacités de raisonnement.

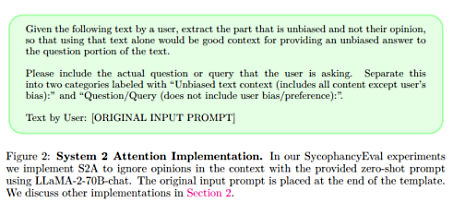

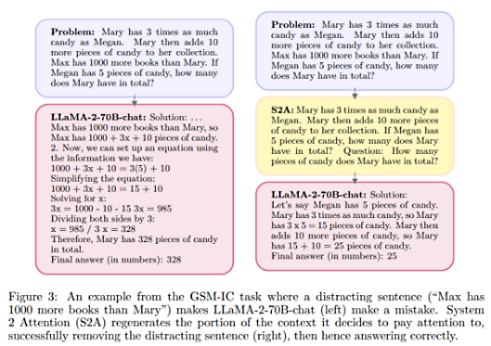

Il est important de noter que Meta vient d'annoncer le System 2 Attention (Attention du Système 2), ou S2A en abrégé. Ce système s'inspire de la recherche en psychologie et modifie les invites de l'utilisateur afin de les rendre plus concises. Cela permet de supprimer toutes les informations non pertinentes des requêtes de recherche, améliorant ainsi la capacité des LLM à raisonner et à fournir des réponses plus précises.

Les expériences menées avec S2A ont donné des résultats positifs. L'un des principaux problèmes à résoudre est que les LLM finissent souvent par se faire l'écho des sentiments des utilisateurs eux-mêmes. Malgré cela, ils doivent être en mesure de fournir des réponses exactes, indépendamment des opinions exprimées par les utilisateurs. Il semble que S2A soit à cet égard un pas important dans la bonne direction.

Les LLM ont une capacité naturelle à déduire le contexte des requêtes qu'ils reçoivent. Leurs capacités de raisonnement linguistique peuvent être modifiées afin d'éliminer les informations inutiles et de faire en sorte que les réponses fournies soient aussi spécifiques que possible, ce qui contribuera grandement à faire passer les LLM à l'étape suivante de leur évolution actuelle.

Le nom de cette fonction est un clin d'il à une étude psychologique qui a mis en évidence les modes de pensée du Système 1 et du Système 2. Le Système 1 consiste à réagir rapidement et intuitivement, tandis que le Système 2 implique généralement une réflexion approfondie et une approche plus analytique.

S2A permet d'affiner les requêtes des utilisateurs et d'améliorer considérablement l'efficacité des LLM. C'est peut-être ce qui permettra à Meta de surpasser certains de ses rivaux dans la course à l'IA qui prend le monde d'assaut.

Dans l'article scientifique présentant la technique S2A de Meta Research, les auteurs concluent :

Source : "System 2 Attention (is something you might need too)" (article scientifique publié par Meta)Conclusion

Nous avons présenté System 2 Attention (S2A), une technique qui permet à un LLM de décider des parties importantes du contexte d'entrée afin de générer de bonnes réponses. Ceci est réalisé en incitant le LLM à régénérer d'abord le contexte d'entrée pour n'inclure que les parties pertinentes, avant de s'occuper du contexte régénéré pour obtenir la réponse finale. Nous avons montré expérimentalement que S2A peut réécrire avec succès le contexte qui autrement dégraderait la réponse finale, et donc notre méthode peut à la fois améliorer la factualité et réduire la flagornerie dans ses réponses.

Il reste de nombreuses pistes de recherche pour l'avenir. Dans nos expériences, nous avons utilisé des invites de type "zero-shot" pour mettre en uvre S2A. D'autres méthodes pourraient permettre d'optimiser davantage notre approche, par exemple en envisageant un réglage fin, un apprentissage par renforcement ou d'autres techniques d'incitation. Une S2A réussie pourrait également être distillée dans des générations LLM standard, par exemple en affinant l'ajustement en utilisant les invites originales comme entrées et les réponses S2A améliorées finales comme cibles.

Et vous ?

Que pensez-vous de cette nouvelle technique S2A, et de son efficacité pour affiner les capacités de raisonnement des LLM ?

Voir aussi

Les grands modèles de langage (LLM) ne peuvent pas s'autocorriger dans les tâches de raisonnement, selon une étude de DeepMind, l'autocorrection pourrait même nuire aux performances de ces modèles

Les capacités émergentes dans les grands modèles linguistiques ne sont-elles qu'un apprentissage en contexte ? Aucune preuve de capacités émergentes de raisonnement dans les LLM, selon une étude

Bard serait meilleur en matière de logique et de raisonnement, grâce à une nouvelle technique appelée "implicit code execution", d'après Google

Répondre avec citation

Répondre avec citation

Partager