Alibaba, le géant technologique chinois, lance un modèle d'IA en libre accès pour tenter de concurrencer le Llama 2 de Meta.

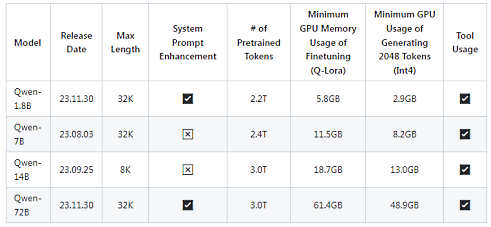

La société basée à Hangzhou a déclaré dans un communiqué de presse qu'elle avait mis en libre accès deux grands modèles de langage (LLM), un type de modèle d'IA, nommés Qwen-7B et Qwen-7B-Chat, jeudi. Chaque modèle compte 7 milliards de paramètres, ce qui est souvent utilisé pour mesurer la puissance. C'est la première fois qu'une grande entreprise technologique chinoise met en libre accès ses LLM.

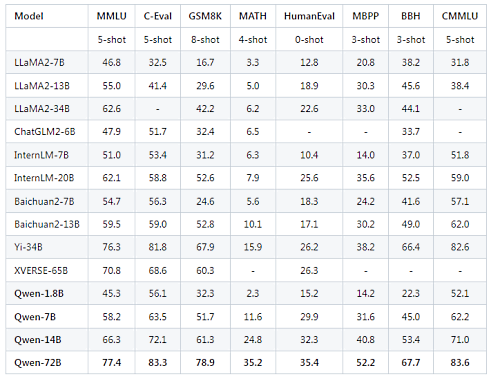

Elle intervient également après que Meta a dévoilé le mois dernier un modèle similaire en libre accès, appelé Llama 2, qui a suscité un grand intérêt. Certains analystes estiment que les modèles en libre accès peuvent réduire la domination actuelle du marché par OpenAI, le développeur de ChatGPT, et Google, dont les modèles d'IA font payer des frais élevés aux utilisateurs.

Alibaba Cloud a annoncé en avril son LLM, baptisé Tongyi Qianwen, qui se décline en plusieurs versions comportant différents nombres de paramètres. Alibaba a déclaré que Qwen-7B et Qwen-7B-Chat sont deux versions de petite taille de Tongyi Qiawen qui visent à aider les petites et moyennes entreprises à commencer à utiliser l'IA. "Le code, les poids des modèles et la documentation des deux modèles seront librement accessibles aux universitaires, aux chercheurs et aux institutions commerciales du monde entier", a déclaré l'entreprise.

Toutefois, les entreprises comptant plus de 100 millions d'utilisateurs actifs mensuels devront demander une licence à Alibaba avant d'utiliser les deux modèles. De même, le Llama 2 de Meta nécessite une licence pour les utilisateurs de plus de 700 millions d'utilisateurs.

Alibaba a déclaré que Tongyi Qianwen possédait des versions comportant un plus grand nombre de paramètres qui n'ont pas été mis en libre accès, mais elle n'a pas précisé combien de paramètres contenait son plus grand modèle. La plus grande version du Llama 2 de Meta comporte 70 milliards de paramètres.

La Chine tente de rattraper les États-Unis dans le domaine de l'IA, Pékin encourageant les entreprises chinoises à développer rapidement des modèles d'IA nationaux et "contrôlables" capables de rivaliser avec ceux mis au point par les entreprises américaines.

Outre Alibaba, les géants de la technologie tels que Tencent Holdings et Huawei ont développé de manière agressive leurs propres modèles d'IA au cours des derniers mois.

Source : Alibaba

Et vous ?

Que pensez-vous de laugmentation de l'offre et donc la concurrence pour les LLM ?

Pensez-vous pouvoir être intéressé par l'offre d'Alibaba ?

Voir aussi :

Le modèle LLamA-2 de Meta, qui vient d'être publié, ne serait pas open source, de l'avis de Alessio Fanelli, Ingénieur logiciel associé chez Decibel

La version professionnelle de ChatGPT est maintenant disponible et coûte 42 dollars par mois, mais beaucoup critiquent ce prix et le jugent "trop élevé pour les utilisateurs occasionnels"

OpenAI sur l'impact économique du GPT-4: « 80% des travailleurs auront au moins 10% de leurs tâches touchées ». L'entreprise affirme que ses produits vont automatiser une vaste gamme de tâches pros

Répondre avec citation

Répondre avec citation

Partager