Rock & Rails : gestes naturels et manipulations spatiales sur les écrans tactiles

Un projet mené par un chercheur de Microsoft

Si ladoption en masse des interfaces tactiles et du multi-touch a entièrement remodelé le marché des téléphones mobiles, elles n'ont pas encore réussi à changer, d'une manière fondamentale, l'interaction des utilisateurs avec les machines.

Les capteurs de ces écrans et les interfaces utilisateurs des applications ne permettent, finalement, quappuyer et imiter les gestes basiques de l'indétrônable souris, encore très présente, malgré les nombreuses prédictions de sa disparition.

En ce sens, des chercheurs de Microsoft tentent d'intégrer à ces surfaces plus de gestes naturels qui proviennent des manipulations spatiales de la vie de tous les jours.

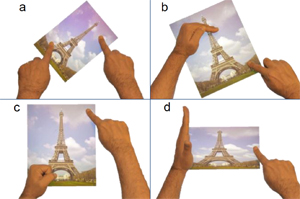

Dans le cadre du projet Rock & Rails, Hrvoje Benko implémente de nouvelles méthodes de reconnaissance des formes tracées et formées par les mains de lutilisateur.

Trois gestes sont pour l'instant supportés : former un trait avec le bord de la main pour créer une sorte de barrière qui peut être utilisée pour redimensionner ou déplacer plusieurs objets en même temps.

L'utilisateur peut aussi utiliser son poing pour retenir un objet ou courber sa main posée sur l'écran pour créer un angle de rotation.

Les résultats de ces recherches feront l'objet d'une publication dans une revue de référence plus tard cette année.

L'unique démonstration accessible sur le site du projet utilise la « table-PC » Microsoft Surface qui repose sur des méthodes de détections différentes et intègre des capteurs nettement plus sensibles que ceux des smartphones et tablettes actuels.

Mais ce n'est probablement qu'une question de temps.

Source : Microsoft Research

Et vous ?

Qu'en pensez-vous ?

Quelles autres manipulations spatiales souhaitez-vous voir les écrans tactiles supporter ?

Répondre avec citation

Répondre avec citation

Partager