Les GPU NVIDIA H100, alias Hopper, ont établi des records lors de leurs débuts avec MLPerf, tandis que les GPU A100 ont montré leur leadership en termes de performances

Dans les tests d'inférence de l'IA, les GPU NVIDIA H100 ont établi des records, les GPU A100 ont montré leur leadership en termes de performances et les Jetson AGX Orin ont dominé l'informatique périphérique.

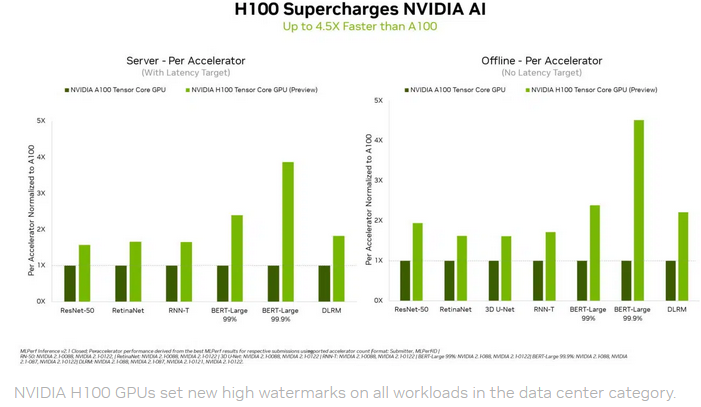

Pour leurs débuts dans les tests d'IA standard MLPerf, les GPU NVIDIA H100 Tensor Core ont établi des records mondiaux dans l'inférence sur toutes les charges de travail, fournissant jusqu'à 4,5 fois plus de performances que les GPU de la génération précédente.

Ces résultats démontrent que Hopper est le meilleur choix pour les utilisateurs qui exigent des performances maximales sur des modèles d'IA avancés.

De plus, les GPU NVIDIA A100 Tensor Core et le module NVIDIA Jetson AGX Orin pour la robotique alimentée par l'IA ont continué à fournir des performances d'inférence de premier plan dans tous les tests MLPerf : reconnaissance d'image et de parole, traitement du langage naturel et systèmes de recommandation.

Le H100, alias Hopper, a relevé la barre des performances par accélérateur dans les six réseaux neuronaux du cycle. Il a démontré sa supériorité en termes de débit et de vitesse dans des scénarios distincts sur serveur et hors ligne.

L'architecture Hopper de NVIDIA a apporté jusqu'à 4,5 fois plus de performances que les GPU de l'architecture Ampere de NVIDIA, qui continuent à fournir le leadership global dans les résultats MLPerf.

Grâce en partie à son Transformer Engine, Hopper a excellé sur le modèle populaire BERT pour le traitement du langage naturel. Il s'agit de l'un des modèles d'IA MLPerf les plus importants et les plus gourmands en performances.

Ces benchmarks d'inférence marquent la première démonstration publique des GPU H100, qui seront disponibles plus tard cette année. Les GPU H100 participeront aux prochains cycles de MLPerf pour l'entraînement.

Les GPU A100 montrent leur leadership

Les GPU NVIDIA A100, disponibles dès à présent auprès des principaux fournisseurs de services de cloud computing et des fabricants de systèmes, ont continué à montrer leur leadership global en matière de performances sur l'inférence d'IA dans les derniers tests.

Les GPU A100 ont remporté plus de tests que n'importe quelle autre solution dans les catégories et scénarios de centres de données et d'informatique périphérique. En juin, l'A100 a également pris la tête des tests d'entraînement MLPerf, démontrant ainsi ses capacités dans l'ensemble du flux de travail de l'IA.

Depuis leurs débuts en juillet 2020 sur MLPerf, les GPU A100 ont multiplié leurs performances par 6, grâce aux améliorations continues du logiciel NVIDIA AI.

NVIDIA AI est la seule plateforme permettant d'exécuter toutes les charges de travail et tous les scénarios d'inférence MLPerf dans les centres de données et l'informatique périphérique.

Les utilisateurs ont besoin de performances polyvalentes

La capacité des GPU NVIDIA à fournir des performances sur tous les principaux modèles d'IA fait des utilisateurs les véritables gagnants. Leurs applications réelles utilisent généralement de nombreux réseaux neuronaux de différents types.

Par exemple, une application d'IA peut avoir besoin de comprendre la demande orale d'un utilisateur, de classer une image, de formuler une recommandation, puis de fournir une réponse sous forme de message oral avec une voix humaine. Chaque étape nécessite un type de modèle d'IA différent.

Les benchmarks MLPerf couvrent ces charges de travail et scénarios d'IA populaires - vision par ordinateur, traitement du langage naturel, systèmes de recommandation, reconnaissance vocale, etc. Ces tests garantissent aux utilisateurs des performances fiables et flexibles à déployer.

Les utilisateurs se fient aux résultats de MLPerf pour prendre des décisions d'achat éclairées, car les tests sont transparents et objectifs. Les critères d'évaluation bénéficient du soutien d'un large groupe comprenant Amazon, Arm, Baidu, Google, Harvard, Intel, Meta, Microsoft, Stanford et l'Université de Toronto.

Orin mène la danse à la périphérie

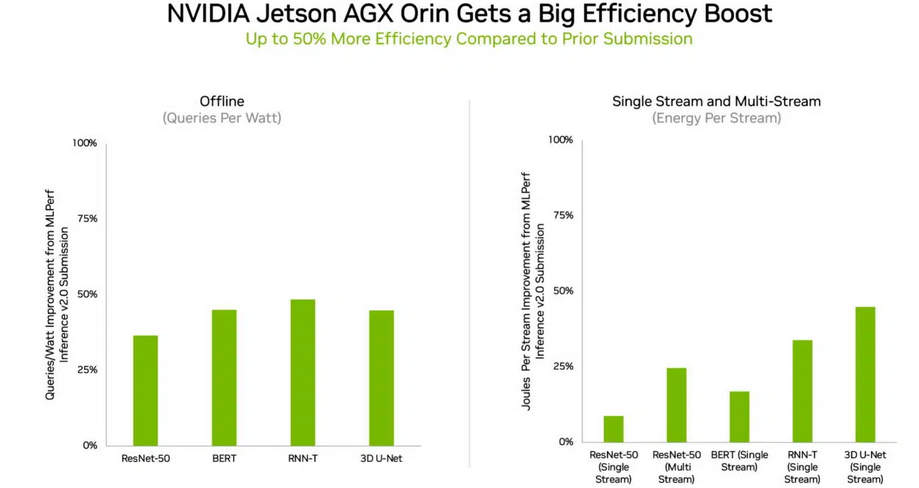

Dans le domaine du Edge Computing, NVIDIA Orin a réalisé tous les benchmarks MLPerf, remportant plus de tests que n'importe quel autre système sur puce basse consommation. Et il a montré un gain de 50% en efficacité énergétique par rapport à ses débuts sur MLPerf en avril.

Lors du tour précédent, Orin a été jusqu'à 5 fois plus rapide que le module Jetson AGX Xavier de la génération précédente, tout en offrant une efficacité énergétique moyenne 2 fois supérieure.

Orin intègre dans une seule puce un GPU d'architecture NVIDIA Ampere et un cluster de puissants curs de CPU Arm. Il est disponible dès aujourd'hui dans le kit de développement NVIDIA Jetson AGX Orin et les modules de production pour la robotique et les systèmes autonomes, et prend en charge l'ensemble de la pile logicielle NVIDIA AI, y compris les plates-formes pour les véhicules autonomes (NVIDIA Hyperion), les appareils médicaux (Clara Holoscan) et la robotique (Isaac).

Large écosystème NVIDIA AI

Les résultats de MLPerf montrent que NVIDIA AI est soutenu par l'écosystème le plus large du secteur de l'apprentissage automatique.

Plus de 70 soumissions dans ce tour ont fonctionné sur la plate-forme NVIDIA. Par exemple, Microsoft Azure a soumis des résultats faisant tourner NVIDIA AI sur ses services cloud.

En outre, 19 systèmes certifiés NVIDIA ont été présentés par 10 fabricants de systèmes, dont ASUS, Dell Technologies, Fujitsu, GIGABYTE, Hewlett Packard Enterprise, Lenovo et Supermicro.

Leur travail montre que les utilisateurs peuvent obtenir d'excellentes performances avec NVIDIA AI à la fois dans le cloud et dans les serveurs fonctionnant dans leurs propres centres de données.

Source : NVIDIA

Et vous ?

Qu'en pensez-vous ?

Voir aussi :

Le limiteur Nvidia LHR officiellement craqué, apportant la pleine vitesse aux opérations de minage sur Windows et Linux

Les hackers derrière le piratage de Nvidia menacent de divulguer des informations plus confidentielles, à moins que l'entreprise ne s'engage à publier en open source ses pilotes

Le passage de Nvidia à l'open source est officiel, la société publie des modules du noyau GPU de Linux en open source avec une double licence GPL/MIT, pour améliorer le support des GPU sous Linux

Répondre avec citation

Répondre avec citation

Partager