Bonjour,

Je suis dev back dans une petite agence web, et pour la première fois de ma carrière, je me retrouve dans la position de référent technique pour les choix de techno, d'archi, et tout le toutim.

Ça fait donc presque un an que je suis passé dans une phase ou j'essaye de comprendre plus en profondeur les outils que j'utilise, et plus seulement faire de la production avec.

Bref, venant s'en au sujet.

Suite à la dernière demande d'un client, je me suis rendu compte que je n'avais aucune idée de l'impact que pouvait avoir une entrée "massive" de données dans une bdd, ni même comment évaluer une charge de donnée tout court.

J'ai beaucoup de mal à trouver des ressources à ce sujet.

Dans le cas présent, j'ai une app avec une petite bdd, (une 15ene de tables, < 100k entrées) et forcement, c'est très réactif, ça fonctionne très bien.

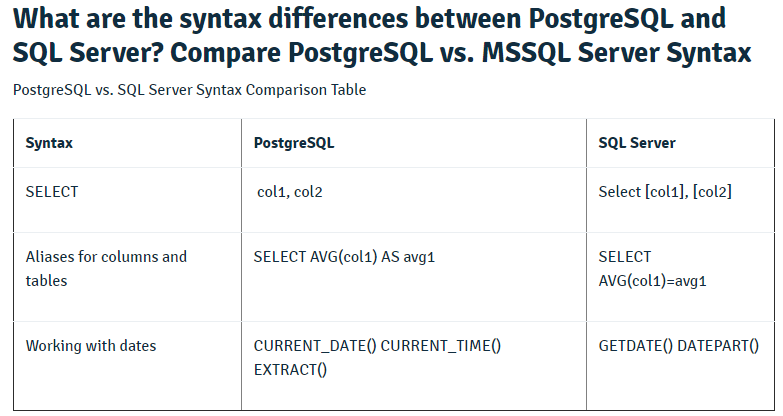

Seulement, là, je doit ajouter une fonctionnalité qui va rajouter potentiellement +300k entrées dans une table par trimestre et j'ai beaucoup de mal à évaluer l'impact que ça va avoir sur les performances de ma bdd (c'est du PostGres).

Ça me parais beaucoup (ça ne l'est peut être pas), et j'ai envie d'externaliser la feature dans un microservice avec sa propre base mais je sous-estime peu être les capacités d'un SGBD.

Est ce qu'il existe des méthodes pour évaluer ça, autre que le doigt mouillé ou l'xp?

Merci.

Répondre avec citation

Répondre avec citation

Partager