L'IA de génération de texte d'Elon Musk trop dangereuse pour être rendue publique

Selon ses créateurs

Lintelligence artificielle continue à bouleverser notre existence, à un rythme accéléré, par de nouvelles applications avancées auxquelles nous navions même pas eu le temps de penser. Ces applications sont mises au point par des chercheurs pour le bien des utilisateurs en leur facilitant de nombreuse tâches. Toutefois, elles peuvent aussi être utilisées à de mauvaises fins par certains acteurs malveillants épris du mal pour détruire ou pour se faire du profit au détriment des autres. Ce comportement pourrait pousser certains chercheurs à éviter de publier leurs recherches de peur qu'elles soient détournées de leur utilisation originelle.

Cest, par ailleurs, dans cette logique quOpenAI, la société à but non lucratif, soutenue par Elon Musk, a décidé de ne pas publier les résultats de ses recherches par crainte d'une utilisation abusive, selon un article du Guardian publié hier. Les créateurs d'un système révolutionnaire d'intelligence artificielle capable d'écrire des reportages et des uvres de fiction, surnommés « deepfakes for text », se sont sentis obligés de renoncer à rendre publique leur uvre, par crainte d'une éventuelle utilisation non recommandée, rompant ainsi avec leur procédure habituelle qui est de publier leur recherche ainsi que les codes sources afférentes.

En effet, le nouveau modèle d'IA mis au point par les chercheurs dOpenAI, appelé GPT2, est si bon et le risque d'utilisation malveillante si élevé qu'ils comptent s'accorder plus de temps pour discuter des conséquences de cette avancée technologique avant de partager la recherche complète avec le public. « Cela semble bien réel », déclare David Luan, vice-président de l'ingénierie chez OpenAI, à propos du texte généré par le système. Lui et ses collègues chercheurs ont commencé à imaginer comment pareil système pourrait être utilisé à des fins hostiles. « Il se peut qu'une personne qui a des intentions malveillantes soit en mesure de produire de fausses actualités de haute qualité », dit Luan.

A cause de cette préoccupation, OpenAI a préféré publier un document de recherche sur ses résultats, plutôt que son modèle complet ni les 8 millions de pages Web qui ont servi à former le système. Le manque de cadre éthique fondamental, dont souffre la technologie IA et qui ne permet pas de définir à lavance les implications des modèles IA formés, est à la base de lhésitation de lOpenAI et bien dautres organisations.

OpenAI nest pas la seule organisation à hésiter à partager ses recherches en matière de lIA. Selon Wired, Google aussi a décidé le mois dernier de ne plus partager innocemment ni ses nouveaux résultats de recherche sur l'IA ni le code source. La firme a révélé dans un document de politique sur l'IA qu'elle avait imposé des contraintes aux logiciels de recherche qu'elle partageait en raison de craintes d'utilisation abusive. En décembre dernier, Google a également partagé, dans un billet de blog, des informations selon lesquelles la société ne proposera pas « d'API de reconnaissance faciale à usage général avant de résoudre d'importantes questions technologiques et stratégiques. »

La technologie de lIA étant souvent utilisée de façon abusive pour aller contre les libertés des humains (par exemple, son utilisation par les forces de lordre dans plusieurs pays), Microsoft sest joint à un appel à la réglementation, en juillet dernier, pour limiter l'utilisation de la technologie de reconnaissance faciale, en exhortant le Congrès à étudier la technologie et à superviser son utilisation. Dans une autre intervention, le président de Microsoft a déclaré que sans la réglementation de la technologie de reconnaissance faciale, 2024 pourrait ressembler au roman « 1984 ».

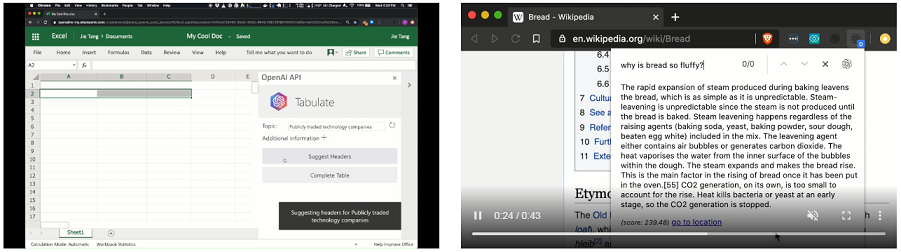

Selon The Guardian, GPT2 dOpenAI est un générateur de texte qui doit être alimenté en texte, de quelques mots à une page entière, et qui est capable d'écrire les phrases suivantes en fonction de ses prédictions sur ce qui devrait arriver ensuite. Selon The Guardian, le système repousse les limites de la génération de texte au-delà de ce que l'on croyait possible, tant sur le plan de la qualité de la production que sur le plan de la grande variété des utilisations possibles. Le système dIA est capable d'écrire des passages plausibles qui correspondent à ce qui lui est donné à la fois dans le style et le sujet. Selon The Guardian, GPT2 montre rarement des textes hors contexte à la différence des systèmes d'IA antérieurs, comme oublier ce qui est écrit au milieu d'un paragraphe ou modifier la syntaxe des longues phrases.

Par exemple, Guardian a alimenté GPT2 avec les premiers paragraphes d'une de ses histoires sur Brexit, et, selon le quotidien, la production du système dIA était de la prose de journal plausible, qui regorgeait de « citations » de Jeremy Corbyn, de mentions de la frontière irlandaise, et de réponses du porte-parole du Premier ministre.

Selon Jack Clark, directeur des politiques chez OpenAI, ce genre dexemple montre comment une telle technologie pourrait bouleverser les processus derrière la désinformation en ligne, dont certaines utilisent déjà une forme d'automatisation.

Les préoccupations dOpenAI peuvent être justifiées par lutilisation des bots par les acteurs malveillants pour diffuser des fausses actualités sur Internet, GPT2 pouvant constituer un outil adapté à leur besogne. En effet, la période électorale 2016 aux Etats-Unis a été troublée par la prolifération des fausses nouvelles sur Internet. Les fausses informations pouvaient être non seulement sous forme de texte, mais également sous forme dimage et de vidéoclips trompeurs faits avec l'apprentissage machine, en combinant et superposant des images et des vidéos existantes sur des images ou des vidéos sources.

Formation du modèle génération de texte dOpenAI

Selon les chercheurs, GPT2 est révolutionnaire à deux égards, du point de vue de la recherche. Le premier atout, cest la taille, a expliqué Dario Amodei, directeur de recherche d'OpenAI. Les modèles « étaient 12 fois plus grands, et l'ensemble de données était 15 fois plus grand et beaucoup plus large » que l'ancien modèle d'IA à la fine pointe de la technologie. GPT2 a été formé sur un ensemble de données contenant environ 10 millions d'articles, sélectionnés en parcourant le site de nouvelles sociales Reddit pour les liens avec plus de trois votes, a rapporté The Guardian. Selon les chercheurs, la vaste collection de textes utilisée pour la formation pesait 40 Go.

Lautre atout, cest la qualité. Le modèle a été formé en lui donnant plus de connaissances sur la façon de comprendre le texte écrit. GPT2 est beaucoup plus général que les modèles de texte précédents. En structurant le texte saisi, il peut effectuer des tâches telles que la traduction et la synthèse, et réussir des tests simples de compréhension de la lecture, souvent aussi bien ou mieux que d'autres outils d'IA conçus spécialement pour ces tâches.

La recherche d'OpenAI s'appuie sur un récent progrès dans le domaine des logiciels de traitement de texte, rendu possible par les nouveaux systèmes d'apprentissage machine qui permettent de mieux rechercher dans le texte des indices contextuels sur la signification d'un mot, a rapporté Wired. Selon Hammond, cofondateur dune startup appelée Narrative Science qui génère des documents commerciaux tels que des rapports financiers en traduisant les données en texte, le système dIA d'OpenAI montre une fluidité impressionnante et pourrait être utile dans des projets créatifs.

OpenAI espère qu'en exprimant ses préoccupations au sujet de ses propres résultats de recherche, il pourra encourager les chercheurs en intelligence artificielle à être plus ouverts et réfléchis par rapport à ce qu'ils développent et publient.

Source : The Gardian, Wired

Et vous ?

Que pensez-vous du modèle dIA dOpenAI ?

Pensez-vous quun cadre éthique général dutilisation de lIA pourrait intervenir dans un délais proche ?

A votre avis, quest ce qui empêche les acteurs du domaine de développer des normes éthiques pour lutilisation de la technologie ?

Lire aussi

Des entreprises payeraient des utilisateurs Facebook pour poster de fausses critiques sur leurs produits en vente sur Amazon, selon une enquête

Une vidéo deepfake de Donald Trump diffusée sur une chaine de TV nationale ? L'employé responsable a été licencié

Une nouvelle méthode inédite de deepfake a été mise au point par des chercheurs, permettant de transférer le style d'une personne à une autre

Une vidéo truquée montre un discours de Barack Obama critiquant Donald Trump, un appel aux internautes à être vigilants sur les informations en ligne

Le président de Microsoft a déclaré que sans la réglementation de la technologie de reconnaissance faciale, 2024 pourrait ressembler au roman « 1984 »

Répondre avec citation

Répondre avec citation

Partager